Noticias

Bing no siempre responde bien, y es normal

Febrero está siendo un mes de lo más trascendental para Bing, el buscador de Microsoft que hasta hace unas semanas era poco menos que un desconocido para la mayoría (en realidad era conocido, pero muy poco empleado) pero que, gracias a los trabajos conjuntos de Microsoft y OpenAI para implantar en el mismo un chatbot basado en inteligencia artificial, ha trepado hasta las primeras posiciones de las búsquedas más repetidas y del interés de una enorme cantidad de usuarios.

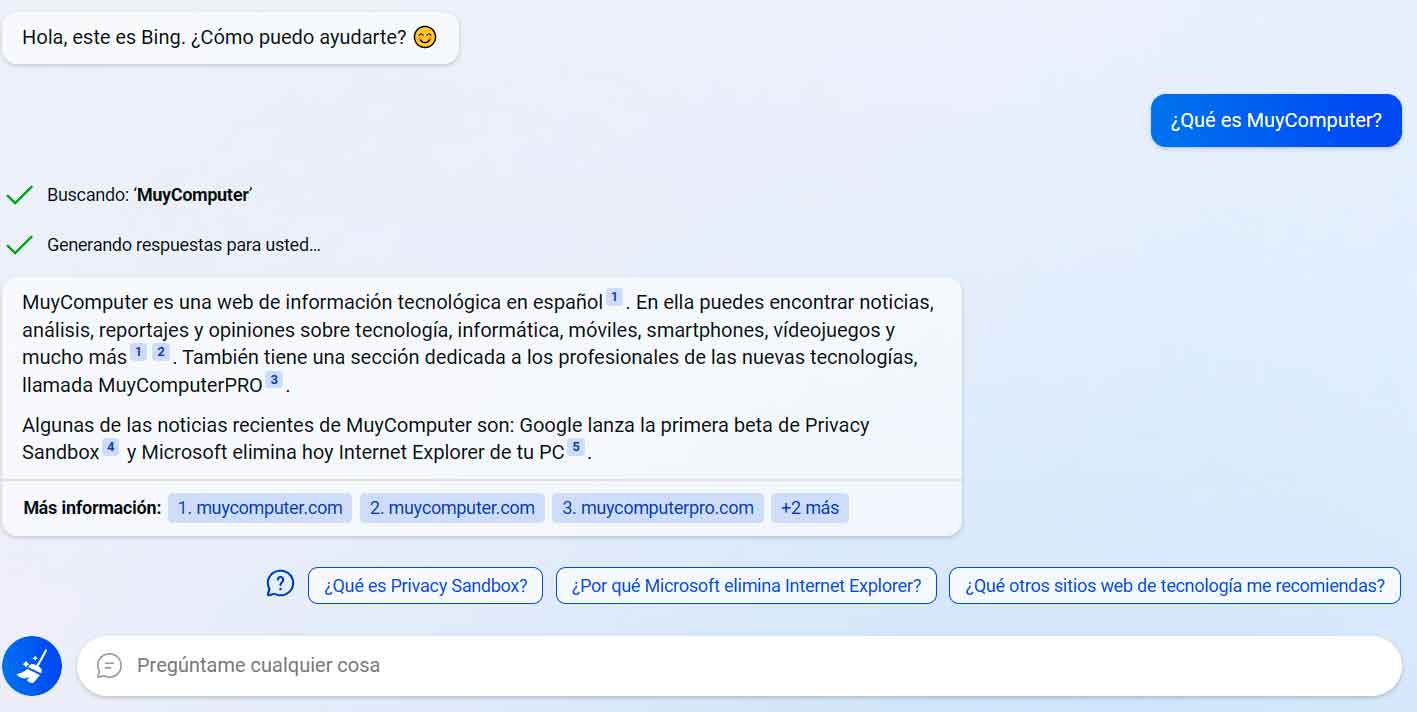

Desde que Microsoft anunciara oficialmente el nuevo Bing con Prometheus, así como el nuevo Microsoft Edge con su modo «copiloto» basado en IA, una legión de usuarios ha querido probar la versión beta del mismo, para la que los de Redmond habilitaron una lista de espera. Nosotros pudimos probarlo hace unos días y, como ya comenté en ese momento, la primera toma de contacto fue bastante positiva, una sensación que se ha ido acrecentando desde entonces, a medida que lo he ido empleando más.

Esto no significa que sea perfecto, claro. Ya lo comenté tras realizar la prueba, y lo hemos podido ver los últimos días a través de las redes sociales. En ocasiones el nuevo Bing puede proporcionar respuestas erróneas, si bien en este punto nos encontramos con una diferencia fundamental con respecto a ChatGTP en estos casos, y es que el buscador de Microsoft siempre nos muestra las fuentes en las que se ha basado para componer su respuestas, por lo que si tiramos un poquito del hilo, podremos confirmar o desmentir sus respuestas.

Algo más distinto y sorprendente es saber que, como han mostrado algunos usuarios en redes sociales, Bing también puede dar respuestas «fuera de tono», más concretamente fuera del tono que Microsoft ha querido establecer para su chatbot. Hemos visto casos en los que divagaba, otros en los que le indicaba a una persona que era (el usuario) un mal usuario mientras que él (Bing) era un buen chatbot… incluso hay quienes afirman que el buscador les ha hecho chantaje emocional.

Microsoft ha publicado, en el blog oficial del buscador, una entrada en la que da acuse de recibo de los fallos, además de compartir parte algunos puntos del aprendizaje de esta primera semana de despliegue del nuevo Bing. En la misma admiten sin reparos los errores del chatbot, afirman estar trabajando para solucionarlos (lo que es una buena señal, pues indica que ya los han identificado y que han podido reproducirlos) y también celebran, lógicamente, que la acogida inicial y la colaboración de los usuarios han sido muy positivas.

Con respecto a los fallos en el comportamiento del chatbot, Microsoft afirma haber descubierto, para su sorpresa (en este punto creo que sí que han sido un tanto inocentes) que no imaginó que Bing se utilizaría para el «descubrimiento general del mundo» o para el entretenimiento social, dos tipos de uso en los que las conversaciones se pueden alargar bastante. ¿Y esto es importante? Pues lo cierto es que sí ya que, según podemos leer en esa publicación, la compañía descubrió que en sesiones extendidas de 15 o más preguntas, Bing puede volverse repetitivo o ser provocado para dar respuestas que no son necesariamente útiles o estar «en línea con el tono designado«.

Así, la tecnológica considera que las largas sesiones de chat pueden confundir al modelo sobre las preguntas que está respondiendo y, en consecuencia, cree que puede necesitar agregar una herramienta para que los usuarios puedan actualizar más fácilmente el contexto o comenzar desde cero. También podemos leer que “el modelo en ocasiones intenta responder o reflejar en el tono en el que se le pide que proporcione respuestas que pueden llevar a un estilo que no pretendíamos. Este es un escenario no trivial que requiere muchas indicaciones, por lo que la mayoría de usuarios no se encontrarán con él, pero estamos buscando cómo brindar un control más preciso”.

Además, y debo recordar que esto me ha recordado un poco a Interstellar, la película de Christopher Nolan, porque otra medida que contemplan es la de agregar un conmutador que le daría a los usuarios más control sobre cuán creativo quieren que Bing sea al responder a su consulta. En teoría, este control podría evitar que Bing haga comentarios extraños pero, en la práctica, estoy convencido de que serán muchos los que, si es posible, lo ajustarán a la máxima creatividad, pues no olvidemos que esto puede resultar divertido para muchos usuarios.

Por lo demás, podemos leer que en general la acogida ha sido muy buena, que un 71% de las respuestas dadas por el chatbot del nuevo Bing obtuvieron un «pulgar arriba», es decir, una valoración positiva, y que los participantes de esta primera fase beta están proporcionando mucha información importante de cara a pulir su funcionamiento. Además, la compañía también indica que el nuevo Bing recibe actualizaciones diarias, por lo que su ritmo evolutivo es bastante rápido.

¿Y por qué he dicho al principio que es normal que falle? Porque estamos hablando de una tecnología terriblemente compleja, sometida al criterio particular de cada uno de los muchos usuarios que ya han obtenido acceso y que, no lo olvidemos, se encuentra en fase beta desde hace tan solo una semana. Cuando vimos los fallos de ChatGPT, hace ya unos meses, no dudé en afirmar que pese a ello ese chatbot era genial, y Bing recoge lo mejor de aquel y le suma velocidad, conexión a Internet, transparencia sobre las fuentes… en fin, muchas mejoras a algo que ya era bueno.

Seguiremos viendo casos de comportamientos extraños en el nuevo Bing, y los ingenieros de Microsoft y de OpenAI tendrán que enfrentarse a algunos problemas-desafíos especialmente complejos, pero cada vez está más claro y admite menos discusión que estamos en los albores de un nuevo paradigma en lo referido a la interacción con las herramientas de búsqueda de información en Internet y, de hecho, con el acceso a la información misma. Ahora bien, no debemos olvidar la complejidad subyacente y entender que todavía queda mucho camino de evolución por delante.

Que no falle es, en este punto tan temprano, poco menos que imposible, pero lo verdaderamente importante es la respuesta por parte de Microsoft y OpenAI a dichos fallos y, en este punto, parece que ambas están actuando del mejor modo posible.

-

PrácticosHace 4 días

PrácticosHace 4 díasCómo se usa Win10Privacy para controlar la privacidad en Windows

-

GuíasHace 7 días

GuíasHace 7 díasGuía de montaje de PC perfecto para gaming en 1080p por 858 euros

-

A FondoHace 6 días

A FondoHace 6 díasNVIDIA presenta el «superchip» RTX Spark, un nuevo camino para Windows sobre ARM

-

NoticiasHace 6 días

NoticiasHace 6 díasDuckDuckGo, el éxito de la búsqueda sin IA