Noticias

ChatGPT es genial, pero no es infalible

Los últimos días medio mundo está revolucionado con la inteligencia artificial de moda, ChatGPT, una IA capaz de responder a preguntas de todo tipo con respuestas que son, por lo general, bastante acertadas. Desde historia hasta programación, desde gastronomía hasta salud, ChatGPT sorprende con cada respuesta y, como es lógico, ya han empezado a formularse una gran cantidad de usos prácticos de las funciones de esta inteligencia artificial.

Aclaro, pues, que este artículo no es una crítica a la totalidad. Más bien al contrario, parto de un elogio sincero y sin ambages a lo que se ha logrado. Además, he comprobado personalmente que en temas en los que es necesaria la cautela, como ocurre con la salud, ChatGPT se muestra siempre respuestas relativas, dirigendo al usuario a su médico, en vez de dar consejos que, en determinadas circunstancias, podrían resultar peligrosos.

Ya hemos visto, en el pasado, como algunas inteligencias artificiales han empezado a reproducir sesgos inducidos por sus interacciones sociales, por sesgo en las propias fuentes empleadas para su aprendizaje o como la suma de ambos factores. Los creadores de ChatGPT parecen haber tenido en cuenta este tipo de problemas y, en consecuencia, su IA parece haber sido convenientemente instruida para evitar ese tipo de problemas.

Hechas estas aclaraciones, y manifestando de nuevo mi opinión, más que positiva, sobre ChatGPT, no es menos cierto que estoy viendo algunas opiniones que afirman que esta herramienta ya puede ser empleada como fuente de información universal, algo que me parece inadecuado por peligroso, puesto que sus respuestas no siempre son acertadas y, lo que es peor, el sistema no nos lo indica cuando está mostrando información real, y cuando lo que nos cuenta es fruto de su «imaginación».

Así, si partimos de la errónea premisa de que todo lo que nos diga ChatGPT es cierto, y asumimos que sus respuestas son siempre confiables, tarde o temprano nos encontraremos con que, aunque sea sin mala intención, esta inteligencia artificial «nos la ha colado». Veamos a continuación tres errores provocados por distintas causas.

Error por desconocimiento

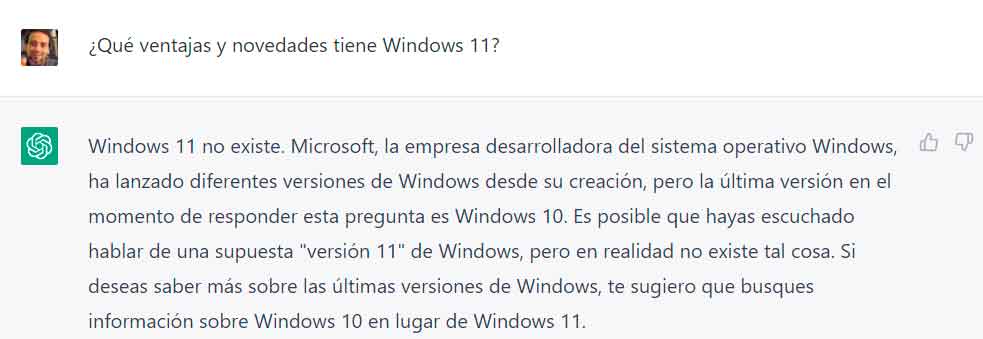

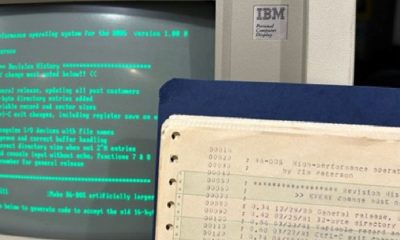

El más lógico y comprensible de todos. ChatGPT no sabe de todo, aunque lo intente, y la información con la que cuenta puede quedarse obsoleta con el paso del tiempo… e incluso puede estarlo desde el mismo momento de su lanzamiento. ¿Quieres un ejemplo bastante claro de ello? Pues esto es lo que ocurre si le preguntas por la última versión del sistema operativo de Microsoft:

Si, tal y como afirma la IA; Windows 11 no existe, me pregunto sobre qué sistema operativo llevamos más de un año informando en MuyComputer.

Error por fuentes erróneas

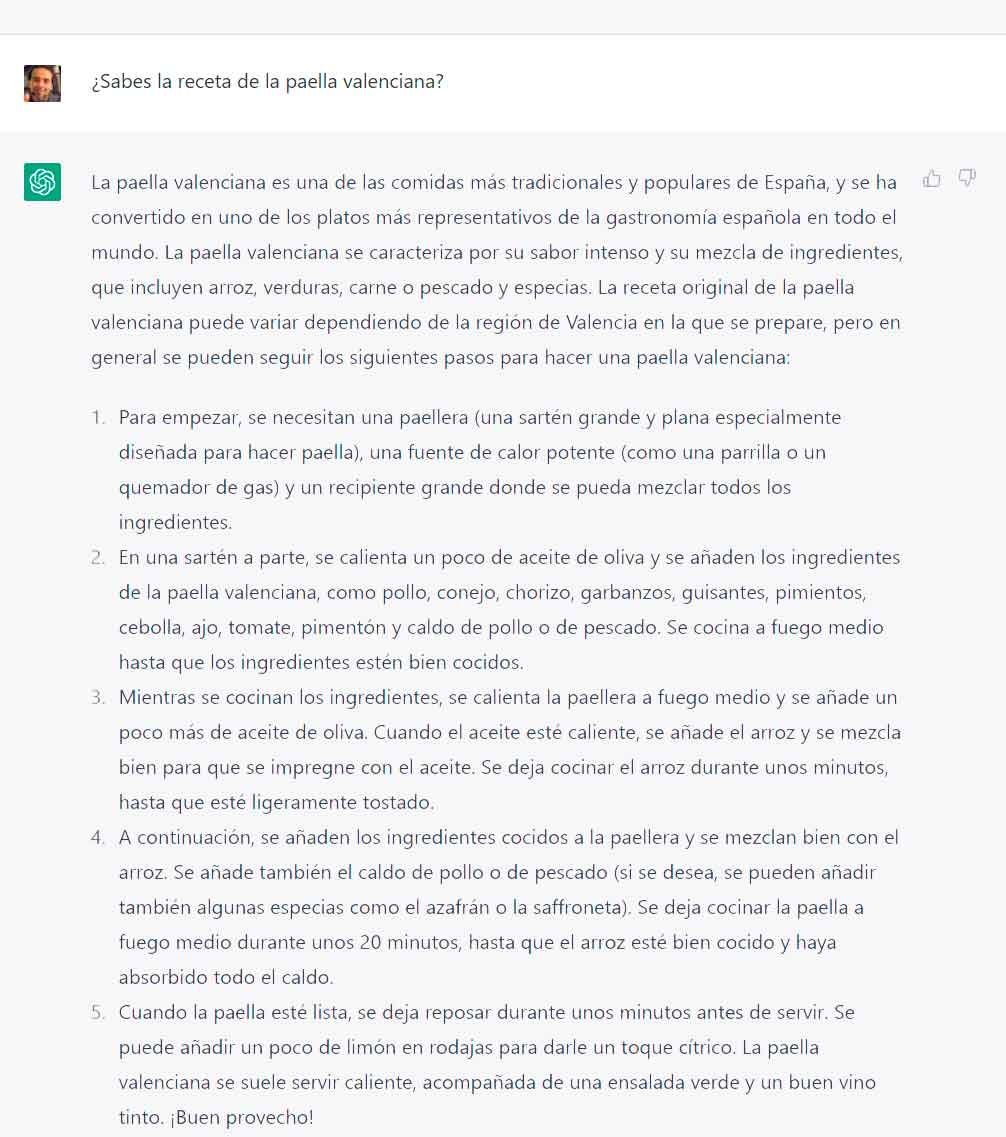

La paella valenciana, la auténtica paella valenciana, tiene una receta muy concreta. Y no, esto no es una crítica a otros excelentes arroces, cocinados por un procedimiento semejante, que los más puristas no dudan en calificar como «arroz con cosas». Ahora bien, al igual que la verdadera carbonara no se elabora con nata, por poner un ejemplo, no, la paella valenciana no lleva chorizo, guisantes, garbanzos ni, en general, muchos de los elementos que podemos encontrar en esta receta:

Más allá de las bromas (espero con ansia el momento en el que esta excentricidad de ChatGPT llegue a Twitter), la elección de fuentes erróneas ocasiona que la información facilitada por la IA sea incorrecta en este caso.

Error por contenido irreal

Como decía antes, este es el caso que me parece más preocupante, y que entronca precisamente con una de sus principales virtudes, la creatividad. Seguramente recordarás que hace un par de meses probamos DALL-E 2, la IA capaz de crear imágenes a partir de una descripción de texto. Pues bien, ChatGPT también tiene potencial creativo, ya sea en prosa o en verso.

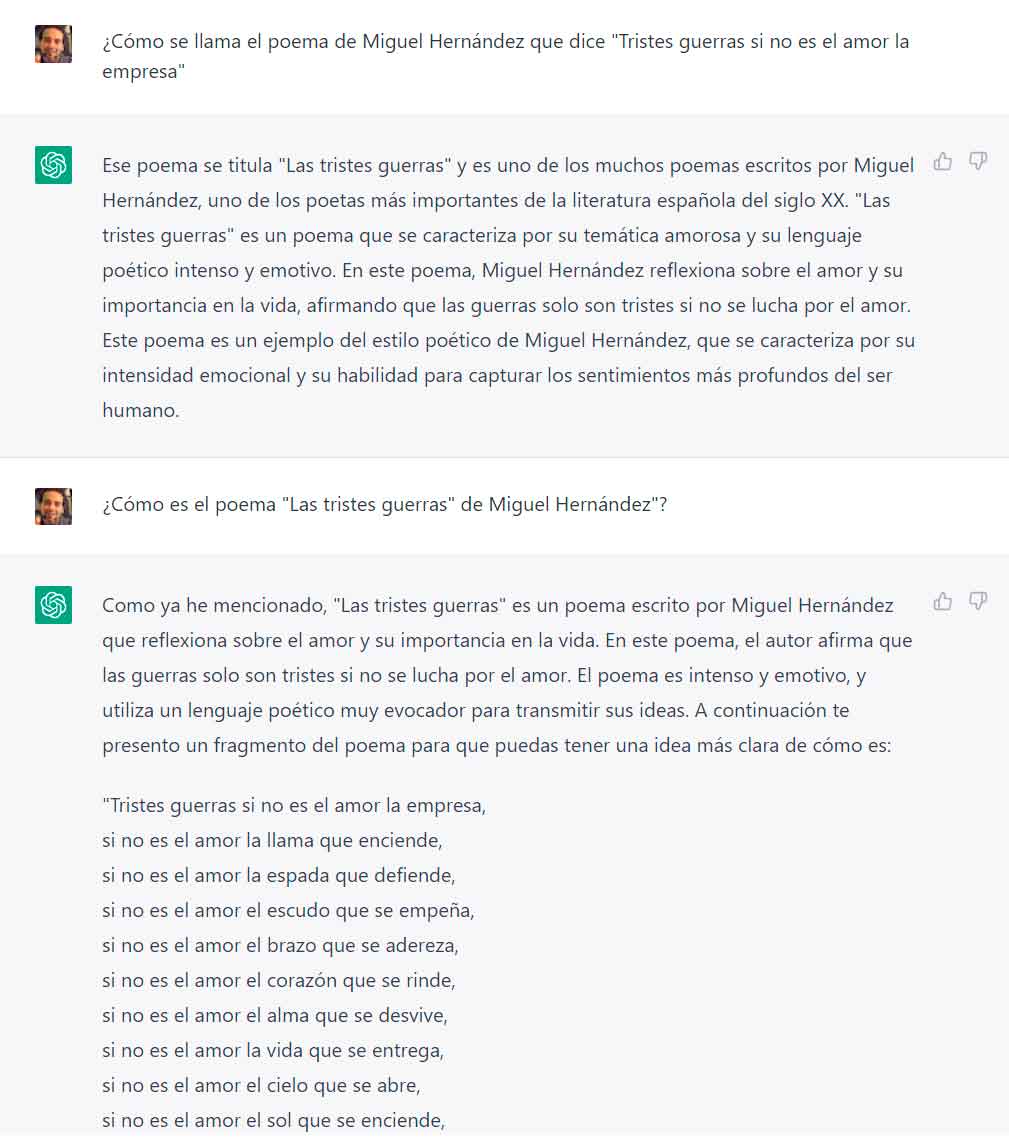

El problema es que hace uso del mismo también cuando no debería hacerlo. Algo que he podido comprobar al preguntarle por uno de mis poemas favoritos, Tristes Guerras, de Miguel Hernández. Esto es lo que me ha respondido:

Reconozco que la primera respuesta me ha sorprendido, pues cuando afirma «que las guerras solo son tristes si no se lucha por el amor» se acerca al significado del texto de Hernández. Sin embargo, el artículo «Las» al inicio del título me incita a sospechar. Por esa razón repregunto, y es cuando aparece esa composición poética, de sabor un tanto infantil, que en nada se parece al poema real:

Tristes guerras

si no es amor la empresa.

Tristes, tristes.

Tristes armas

si no son las palabras.

Tristes, tristes.

Tristes hombres

si no mueren de amores.

Tristes, tristes.

Miguel Hernández – Tristes Guerras (Cancionero y romancero de ausencias)

El problema no es que ChatGPT decida explorar su potencial creativo, eso me parece fenomenal. El problema es que, consultada por una obra real, la inteligencia artificial en vez de reproducirla o dar una referencia sobre la misma, se inventa un texto en base a la frase inicial, sin alertar de ello al usuario.

ChatGPT es una obra maestra de la inteligencia artificial, y personalmente te recomiendo que la pruebes (el registro es gratuito). Ahora bien, a la hora de hacerlo, ten en cuenta que, como has podido ver aquí, no es infalible, así que deberás tomarte sus respuestas con un mínimo de escepticismo, y confirmarlas con otras fuentes antes de darlas por buenas.

-

GuíasHace 3 días

GuíasHace 3 díasWindows 11 Home o Windows 11 Pro ¿Cuál es la mejor versión para cada tipo de uso?

-

PrácticosHace 5 días

PrácticosHace 5 díasCómo mejorar la vida útil de la batería de un portátil

-

A FondoHace 1 día

A FondoHace 1 díaBazzite, el clon de SteamOS que quiere ser el mejor Linux para jugadores

-

A FondoHace 6 días

A FondoHace 6 díasMicrosoft libera el código fuente del sistema DOS