Noticias

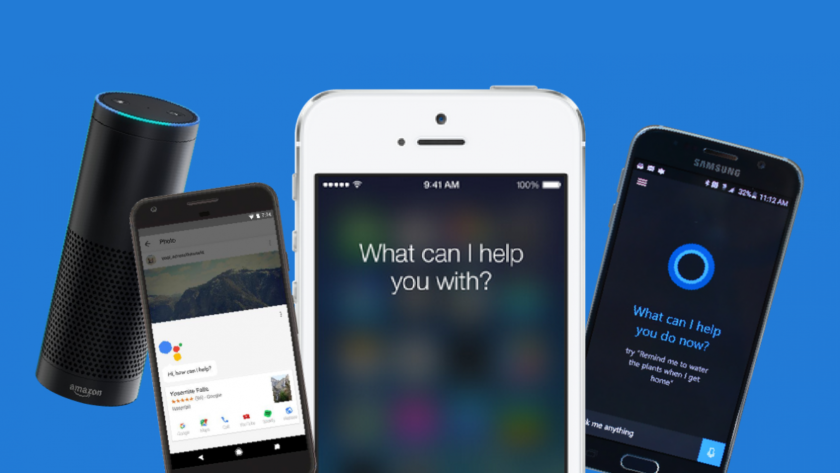

Detectada gran vulnerabilidad en los asistentes de voz

Un grupo de estudiantes de la universidad estadounidense de Berkeley ha descubierto una vulnerabilidad en los asistentes de voz de Apple, Amazon y Google. Y es que según afirman, sería posible controlar a Siri, Alexa y Google Assistant mediante mensajes ocultos e indetectables por el oído humano, y que podrían esconderse en cualquier vídeo o canción.

Anunciando su descubrimiento en primicia a través del periódico New York Times, han afirmado que esto podría suponer un riesgo de seguridad importante para los usuarios de altavoces inteligentes. Y es que los dispositivos y asistentes no estarían siendo hackeados, sino simplemente engañados.

Gracias a este experimento, han demostrado la capacidad de dar órdenes a estos asistentes escondiendo pequeños mensajes en canciones, e incluso a través de ruido blanco, completamente imperceptible por una persona. Esto implica una nueva amenaza y formas de “ataques”, pudiendo ahora esconderse estos mensajes subliminales tanto en cualquier canción de la radio, en anuncios de televisión, e incluso en vídeos de YouTube.

En estas declaraciones hablaron también de que ya se habían demostrado técnicas similares, mediante el uso de frecuencias ultrasónicas: «Investigadores de la Universidad de Princeton y la Universidad de Zhejiang de China demostraron que los sistemas de reconocimiento de voz podrían activarse mediante el uso de frecuencias inaudibles para el oído humano. El ataque primero silenciaba el teléfono para que el propietario no escuchara las respuestas del sistema.«. Algo que ha desatado la inquietud en algunos de los usuarios, ante la falta de una inminente solución.

Y es que como afirma Nicholas Carlini, uno de los investigadores, «Si bien no hay evidencias de que estas técnicas hayan salido del laboratorio, es posible que solo sea una cuestión de tiempo antes de que alguien empiece a explotarlas«.

Aunque a primera vista puede no parecer un mal mayor, la activación de los asistentes virtuales, sin que los dueños sean siquiera conscientes de ello, podría implicar permitir a los atacantes abrir páginas web, enviar mensajes, realizar llamadas, e incluso añadir objetos a listas de compras (como ya pasó anteriormente con Alexa y el anuncio de la casa de muñecas en EE.UU.).

Sin embargo, en el caso de los dispositivos inteligentes conectados con nuestro hogar, los riesgos serían incluso mayores. Esta vulnerabilidad podría dar el control ajeno para apagar las luces, abrir o cerrar puertas, e incluso controlar las alarmas.

Con la publicación de este hallazgo, este grupo de estudiantes ha querido dar el aviso y alerta a las grandes compañías de los asistentes, para tratar de poner una solución al problema cuanto antes. Es una suerte que esta vez el fallo haya sido encontrado por un grupo de personas honestas, ayudando a minimizar los posibles daños.

-

PrácticosHace 2 horas

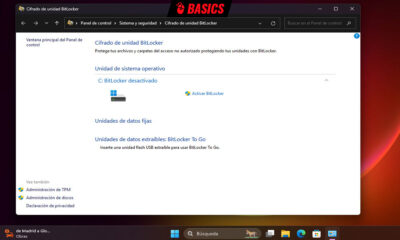

PrácticosHace 2 horasCómo evitar que Windows 11 cifre (por su cuenta) las unidades de almacenamiento

-

NoticiasHace 7 días

NoticiasHace 7 díasBloodborne Remaster en PC es real: trazado de rayos, texturas e iluminación mejoradas

-

NoticiasHace 6 días

NoticiasHace 6 díasEl mejor emulador de PS4 recibe una gran actualización

-

A FondoHace 7 días

A FondoHace 7 díasPS5 frente a PC en trazado de rayos y de trayectorias: ¿a qué tarjeta gráfica equivale?