A Fondo

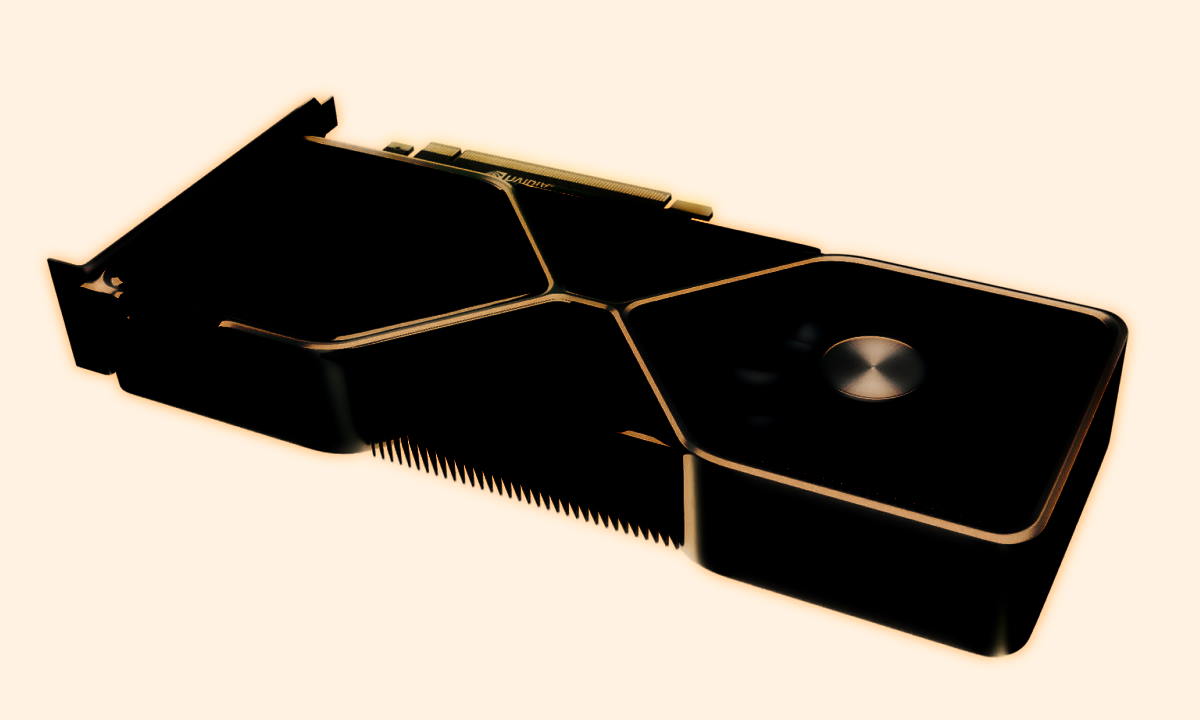

GeForce RTX 4090, todo lo que sabemos de momento

La GeForce RTX 4090 se convertirá en la próxima tarjeta gráfica estrella de NVIDIA dentro del mercado de consumo general de alto rendimiento, y promete marcar una mejora importante en términos de rendimiento, siempre que se cumplan todas las filtraciones y rumores que hemos ido viendo hasta ahora.

Sé que la GeForce RTX 4090 es uno de los componentes gaming más esperados del momento, y que está generando una gran expectación, pero al mismo tiempo también está sembrando algunas dudas por la cantidad de informaciones contradictorias que han ido apareciendo durante las últimas semanas. Por ello, he querido recopilar la información más importante, y más creíble, en este artículo, donde veremos todas sus claves, incluyendo desde las especificaciones hasta su potencia, su consumo y su posible precio.

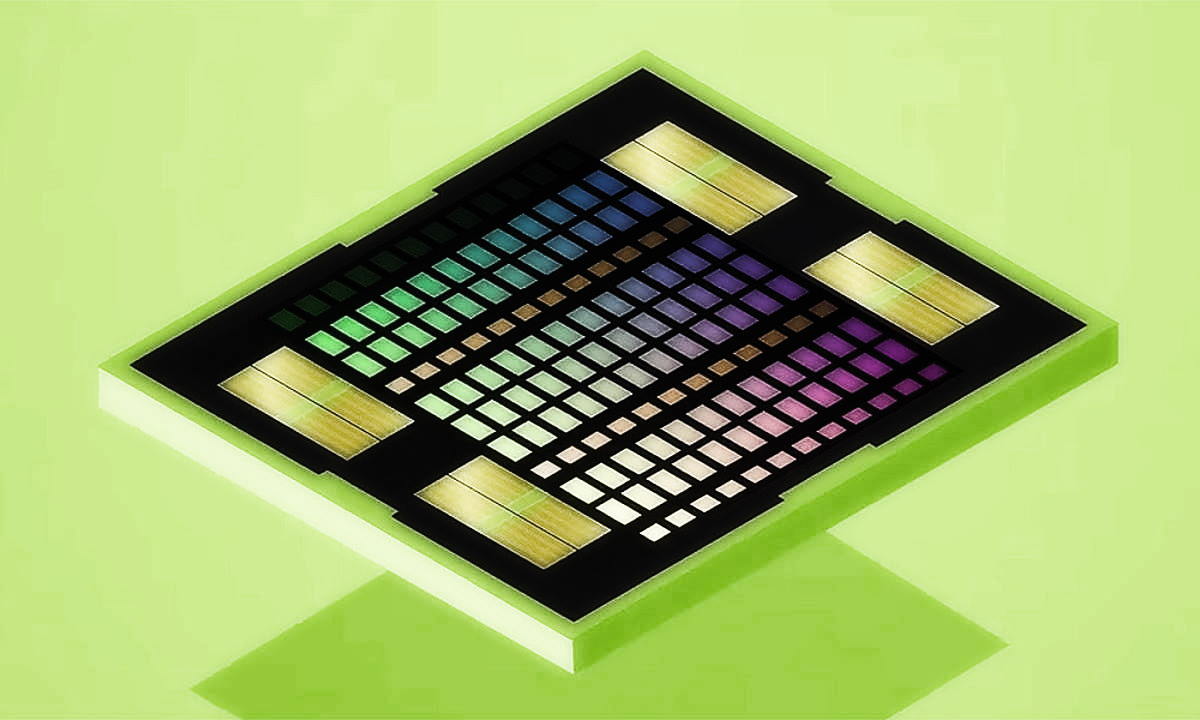

Es importante que tengáis en cuenta, antes de nada, que la GeForce RTX 4090 utilizará una arquitectura totalmente nueva, es decir, será la sucesora de Ampere, y esto implica que NVIDIA podría introducir cambios más o menos marcados a nivel de silicio. Por ahora, todo parece indicar que Ada Lovelace, la arquitectura que dará vida las GeForce RTX 40, mantendrá el diseño de núcleo monolítico, y también la división de 128 shaders, 4 unidades de textura, cuatro núcleos tensor y un núcleo RT por unidad SM. Como vemos, la integración de núcleos especializados en un mismo chip seguirá siendo clave.

No obstante, algunas fuentes han venido diciendo que NVIDIA podría haber cambiado de planes, y que Ada Lovelace adoptará un diseño multichip, como ha hecho AMD con su serie Instinct 200, algo que, francamente, me parece muy poco probable, sobre todo porque no estamos hablando de un tema que pueda cambiarse fácilmente y de la noche a la mañana. Con esto quiero decir que Ada Lovelace es una arquitectura que ya llevaba tiempo en manos del departamento de I+D de NVIDIA, y que no es algo que se pueda desechar sin más para embarcase a ritmo acelerado en un proyecto multichip.

Por otro lado, tampoco es un cambio necesario. Con las RTX serie 30, NVIDIA demostró que el diseño de núcleo monolítico todavía tenía mucha vida en el sector GPU, y todo parece indicar que la GeForce RTX 4090 llevará esta realidad al extremo. Tanto es así que dicha solución gráfica sí que podría marcar el principio del final de los diseños de GPU monolítica en el sector de consumo general. Por si alguien se ha perdido, os recuerdo que un diseño de núcleo monolítico implica que la GPU queda aglutinada en una única pastilla de silicio, mientras que en un diseño multichip la GPU está formada por dos o más chips unidos que trabajan de forma conjunta.

Posibles especificaciones de la GeForce RTX 4090

La GeForce RTX 4090 utilizará el nuevo núcleo gráfico AD102, al menos según las filtraciones más recientes que he podido ver. Tiene sentido porque la GeForce RTX 3090 está basada en el núcleo gráfico GA102, pero sin duda lo más interesante es el enorme conteo de shaders que traerá, en teoría, esa GeForce RTX 4090, nada más y nada menos que 18.432 shaders.

Si partimos de la división que hemos visto en Ampere, esos 18.432 shaders que monta la GeForce RTX 4090 se traducirían en 144 unidades SM. Si cada unidad SM tiene 4 unidades de textura, cuatro núcleos tensor y un núcleo RT, nos encontraríamos con un total de 576 unidades de texturizado, 576 núcleos tensor de cuarta generación y 144 núcleos RT de tercera generación.

También cabe esperar un salto notable en las frecuencias de trabajo de la GPU AD102. Teniendo en cuenta los valores en los que se mueve la GeForce RTX 3090 cuando entra en funcionamiento el modo turbo, podemos esperar que la GeForce RTX 4090 ronde sin problema los 2,3 GHz, o puede que incluso un poco más. Si esto se confirma, su potencia en FP32 no bajaría de los 85 TFLOPs. A efectos comparativos, os recuerdo que la GeForce RTX 3090 alcanza los 35,58 TFLOPs.

El subsistema de memoria debería permanecer sin cambios frente al actual tope de gama que tiene el gigante verde en el mercado. Esto quiere decir que la GeForce RTX 4090 contará, probablemente, con un bus de 384 bits y 24 GB de memoria GDDR6X, aunque puede que NVIDIA apure la frecuencia de esta y que la sitúe por encima de los 20 GHz. Si esto ocurre, su ancho de banda podría rozar el terabyte por segundo.

Con el salto generacional que marcará la arquitectura Ada Lovelace, NVIDIA aprovechará para utilizar el nuevo estándar PCIE Gen5 x16, aunque está por ver hasta qué punto acaba esto marcando una diferencia importante ya que, a día de hoy, el estándar PCIE Gen4 x16 marca una diferencia mínima frente al estándar PCIE Gen3 x16, incluso con las tarjetas gráficas más potentes del mercado. En cualquier caso, será interesante ver las primeras comparativas en este sentido.

Por lo demás, podemos esperar que la GPU AD102, utilizada en la GeForce RTX 4090, esté fabricada en proceso de 5 nm de TSMC, un salto importante frente al nodo de 8 nm de Samsung que utiliza actualmente NVIDIA con las RTX serie 30, y que la GeForce RTX 4090 utilice el nuevo conector de 12 pines y 16 líneas que ya os presentamos en su momento en este artículo. A pesar del salto a nivel de proceso, el incremento del conteo de shaders y de potencia de esta GPU disparará el consumo. No tenemos claro hasta qué punto, pero es probable que esa GeForce RTX 4090 llegue con un TBP de entre 450 y 600 vatios.

GeForce RTX 4090: Fecha de lanzamiento, posible rendimiento y precio

Tengo bastante claro que veremos el lanzamiento de la GeForce RTX 4090 en el segundo trimestre del año que viene probablemente a finales del mismo, y que vendrá acompañada de dos tarjetas gráficas más, la GeForce RTX 4080, que se situará un peldaño por debajo de la GeForce RTX 4090, y la GeForce RTX 4070, que posicionará como «gama alta asequible».

Los valores de rendimiento deberían mantenerse más o menos en los baremos que hemos ido viendo con los lanzamientos de generaciones anteriores. Con esto quiero decir que lo más probable es que la GeForce RTX 4090 supere entre un 45% y un 60%, dependiendo del juego y de la resolución utilizada, el rendimiento de la GeForce RTX 3090, mientras que la GeForce RTX 4080 debería ser entre un 20% y un 30% más potente que la RTX 3090, también dependiendo de cada juego y de la resolución. Por último, la GeForce RTX 4070 debería estar, más o menos, al nivel de la GeForce RTX 3080 Ti.

Hablar del precio de las tarjetas gráficas actuales es muy complicado, así que imaginad lo difícil que me resulta valorar el posible coste que tendrá la GeForce RTX 4090. Limitándome al posible precio de venta recomendado, creo que NVIDIA seguirá la línea que vimos con la GeForce RTX 3090, y que por tanto ese nuevo tope de gama será un poco más caro que el modelo anterior, lo que me lleva a situarme en la franja de los 1.699 a los 1.899 dólares. Puedo equivocarme, pero no creo que por mucho.

Obvia decir que, si se mantiene la situación actual, el precio de venta de las tarjetas gráficas de próxima generación podría ser superior al precio recomendado, como ya hemos visto en la generación actual debido a la escasez de semiconductores, a los problemas en la cadena de distribución y a la especulación que vive el mercado de reventa y de segunda mano.

-

PrácticosHace 2 días

PrácticosHace 2 díasCómo se usa Win10Privacy para controlar la privacidad en Windows

-

NoticiasHace 7 días

NoticiasHace 7 díasLa IA entra en una nueva fase: aprender a usarla en el trabajo real

-

AnálisisHace 6 días

AnálisisHace 6 díasGIGABYTE MO27Q28GR análisis completo de este monitor WOLED

-

GuíasHace 4 días

GuíasHace 4 díasGuía de montaje de PC perfecto para gaming en 1080p por 858 euros