Guías

Las cinco peores tarjetas gráficas de los últimos diez años

Durante los últimos años, el mundo del PC ha vivido una importante evolución que ha sacudido el mundo de las tarjetas gráficas. El salto de DirectX 11 a DirectX 12, y la creciente popularidad de Vulkan, ha pasado factura a numerosos modelos de generaciones que no ofrecían un buen soporte de ambas APIs, y los crecientes aumentos del consumo de memoria gráfica ha hecho que muchas soluciones que anteriormente fueron «lo mejor de lo mejor» empiecen a quedarse obsoletas.

Podríamos decir que es ley de vida. Todos los componentes de un PC tienen una vida útil que viene determinada por sus especificaciones en bruto, pero que al mismo tiempo puede verse recortada, o a alargada, en función de otros factores importantes, como por ejemplo su soporte de tecnologías avanzadas y por el camino que decida seguir la industria. Esto último es muy importante, de hecho ya vimos en su momento como el estancamiento alrededor de una API obsoleta, DirectX 11, podía perjudicar a tarjetas gráficas más avanzadas que estaban diseñadas para trabajar con DirectX 12 y Vulkan.

Estoy convencido de que más de uno de nuestros lectores sabrá a qué momento temporal nos hemos referido con el ejemplo anterior, a la etapa en la que coexistieron las dos generaciones de GPUs NVIDIA basadas en Kepler, las GTX 600 y GTX 700 (con la excepción de las GTX 750 y 750 Ti, que estaban basadas en Maxwell), y las Radeon HD 7000 y Radeon RX 200. El dominio de DirectX 11 entre 2012 y 2016, unido a la baja demanda de memoria gráfica de la mayoría de los juegos, hizo que Kepler se mantuviera como una arquitectura muy capaz, pero a día de hoy, con el auge de DirectX 12 y Vulkan, las Radeon HD 7000 y Radeon RX 200 han envejecido mucho mejor.

La potencia en bruto importa, eso está claro, pero cuando hablamos de tarjetas gráficas también debemos tener en cuenta otros factores que ya os hemos adelantado, como la arquitectura, el soporte de APIs y de tecnologías avanzadas y, como no, la cantidad de memoria gráfica instalada. AMD ha venido haciendo mejor las cosas en este sentido, ya que ha integrado configuraciones de memoria más elevadas y ha apostado por dar un mayor soporte a tecnologías que, en su momento, no tenían un buen grado de soporte, como la computación asíncrona, por ejemplo, pero también ha cometido errores.

Podríamos poner muchos ejemplos, pero creo que el más claro lo vivimos con la llegada de las Radeon R9 Fury y Fury X, dos tarjetas gráficas que apostaban por la memoria HBM y que estaban limitadas 4 GB. Esto se convirtió en un problema muy grave cuando los juegos empezaron a consumir más memoria gráfica, y acabó haciendo que ambas quedasen por debajo de sus rivales directos de NVIDIA. La GTX 980 Ti, equipada con 6 GB de memoria gráfica, ha envejecido mejor que la Radeon R9 Fury X.

Queda claro que tanto NVIDIA como AMD han cometido errores en los últimos años, aunque por suerte a día de hoy ambas han sabido jugar bien sus cartas y tenemos un alto nivel de competencia en el sector de las tarjetas gráficas. NVIDIA ha sabido democratizar el trazado de rayos con las RTX 3080 y RTX 3070, y el gigante de Sunnyvale respondió con fuerza con la presentación de las Radeon RX 6000, una generación gráfica que se perfila como un buen valor en relación precio-prestaciones.

Durante las próximas semanas iremos viendo el rendimiento de esa nueva generación gráfica y os contaremos todo lo que debéis saber para valorar si sus diferentes modelos son, realmente, una buena compra. Mientras tanto, y para amenizar la espera, os invitamos a que nos acompañéis a descubrir cuáles han sido las cinco peores tarjetas gráficas de los últimos diez años. Os adelanto que vamos a prescindir de los modelos clásicos de gama baja, que normalmente ofrecen un valor terriblemente malo, para ofreceros un artículo más interesante, completo y menos «predecible».

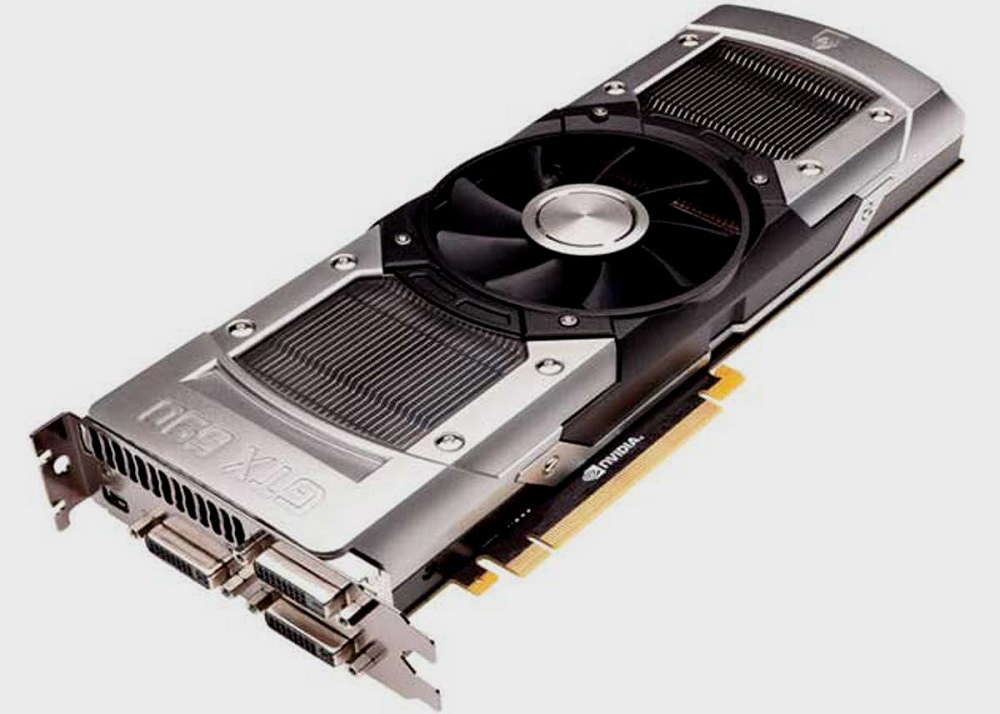

1.-Las cinco peores tarjetas gráficas de la historia reciente: GeForce GTX 690

Desde luego había mucho donde elegir, gracias, sobre todo, a lo mal que ha envejecido la arquitectura Kepler de NVIDA. Es un hecho que dicha arquitectura marcó un cambio muy importante, ya que supuso la desaparición de los «hot shaders» y permitió a NVIDIA triplicar la cantidad de shaders frente a la generación anterior, basada en Fermi.

Para que os hagáis una idea, la GTX 580 contaba con 512 shaders, mientras que la GTX 680 sumaba 1.536 shaders. La segunda triplicaba la cantidad de unidades de sombreado de la primera, pero estos funcionaban a una frecuencia menor ya que, como hemos dicho, se eliminó esa característica conocida como «hot shaders», que permitía que dicho grupo de núcleos funcionase a una frecuencia de trabajo mucho mayor.

Sin embargo, esa importante evolución estuvo empañada por la propia base de una arquitectura que estuvo desarrollada, desde el principio, con DirectX 11 en mente. Esto permitió a NVIDIA ofrecer un rendimiento superior, en la mayoría de los casos, a las Radeon HD 7000 de AMD, y generó una marcada polémica que dio pie a dos posturas enfrentadas: los que decían que NVIDIA había acertado al haber hecho una apuesta sólida con vistas al presente y no al futuro, y los que opinaban justo lo contrario, que AMD iba a envejecer mejor.

Lo cierto es que ambas posturas tenían razón. Los que compraron una GTX basada en Kepler disfrutaron de un buen rendimiento durante varios años, y los que compraron una Radeon HD 7000 se vieron recompensados al ver como su tarjeta gráfica envejecía mejor que las alternativas de la competencia.

Dicho esto, ¿por qué pensamos que la GeForce GTX 690 es una de las peores tarjetas gráficas de los últimos diez años? La respuesta es muy sencilla, porque es un modelo que tiene todas las carencias de Kepler y que presenta, además, todos los problemas inherentes a una configuración de doble GPU. Esta tarjeta grafica equivale a dos GTX 680 en un único PC, lo que significa que cada GPU está limitada a 2 GB de memoria gráfica, y que para desplegar todo su potencial depende del soporte del modo SLI que ofrezca cada juego.

Su precio de lanzamiento fue de más de 1.000 euros, y ha envejecido tan mal que hoy por hoy, en la mayoría de los casos, no rinde mejor que una GTX 680, debido al pobre soporte del modo SLI que presentan la mayoría de los juegos. Fue una inversión terrible que encima ha envejecido muy mal, y por ello merece estar en esta lista.

2.-Las cinco peores tarjetas gráficas de la historia reciente: GeForce GTX TITAN Z

Fue la sucesora de la anterior, y aunque es cierto que en su momento fue un auténtico objeto de deseo, ha envejecido igual de mal que la GTX 690 porque presenta, precisamente, las mismas carencias: está basada en la arquitectura Kepler y sufre todas las complicaciones propias de las tarjetas gráficas con doble GPU. Con todo, debemos decir a su favor que este modelo contaba, al menos, con 6 GB de GDDR5 para cada GPU.

Su configuración a nivel de hardware es mucho más potente que la de la GTX 690, algo que es perfectamente comprensible, ya que la GTX TITAN Z equivale a montar dos GTX 780 Ti Black Edition en un único PCB. Suma 2.880 shaders por cada núcleo gráfico y 6 GB de GDDR5 (12 GB en total), pero tiene un soporte muy pobre de DirectX 12 y Vulkan, y no ha envejecido nada bien.

A día de hoy, en la mayoría de los juegos solo podemos utilizarla en configuración mono GPU, lo que significa que en el mejor de los casos rinde al nivel de una GTX 780 Ti Black Edition, lo que hace que acabe quedando por debajo de soluciones de gama media baja actuales que podemos comprar por menos de 150 euros, algo totalmente decepcionante para una tarjeta gráfica que en su momento costaba más de 3.000 euros.

Para muchos fans de NVIDIA, esta tarjeta gráfica se ha convertido en un valorado objeto de coleccionismo, algo que, unido a la escasa cantidad de unidades que se vendieron en su momento, ha hecho que mantenga un precio muy elevado en el mercado de segunda mano. Si tienes una unidad y estás pensando en venderla podrás sacarle un buen precio si encuentras al comprador adecuado, pero en términos de rendimiento su valor a día de hoy es muy bajo.

Con juegos basados en DirectX 11 y compatibles con el modo SLI, como Crysis 3, la GTX TITAN Z marcaba una diferencia considerable, pero incluso en el mejor de los casos seguía sin ser una buena opción, sobre todo teniendo en cuenta que en aquella época (2014) podíamos encontrar una Radeon R9 295X2, que rendía igual o un poco por encima en algunos casos, por unos 1.500 euros.

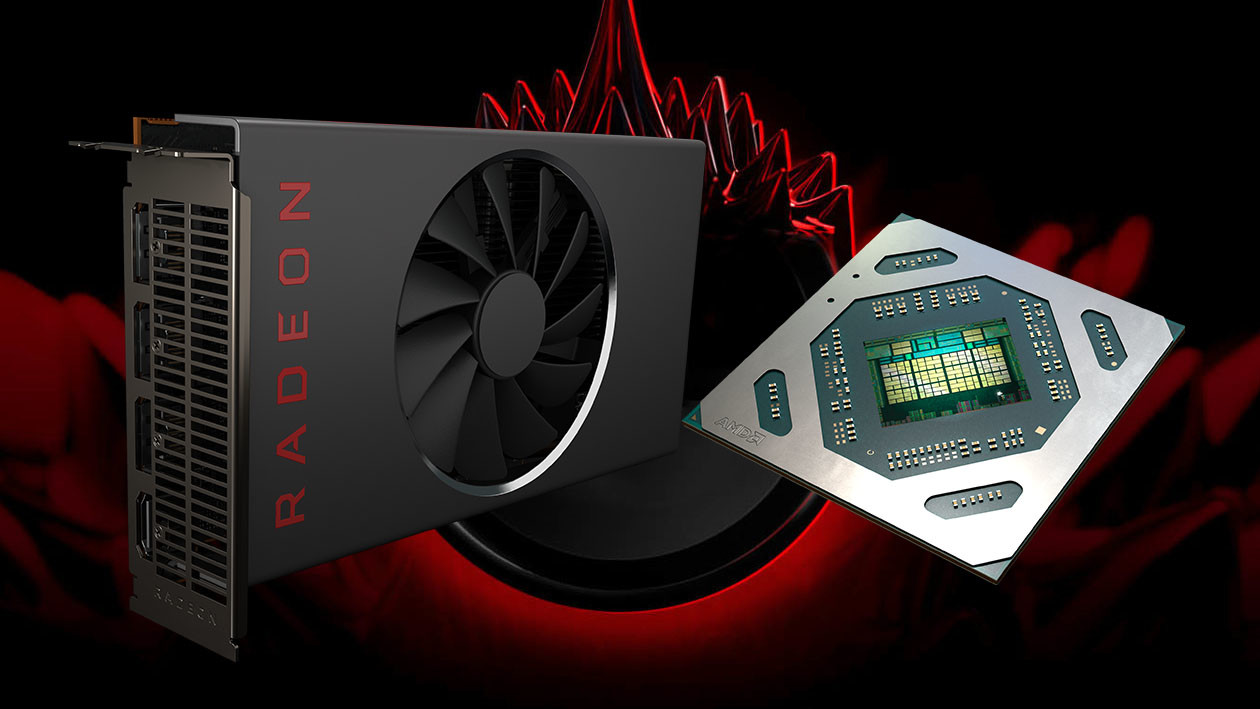

3.-Las cinco peores tarjetas gráficas de la historia reciente: Radeon R9 Fury X

La Radeon R9 Fury X generó una gran expectación, no solo por el alto conteo de shaders que iba a utilizar esta tarjeta gráfica de AMD (4.096), sino también por el hecho de que vendría equipada con memoria HBM. Estas siglas se identifican como «High Bandwidth Memory», es decir, memoria con un alto ancho de banda. Es un tipo de memoria muy particular, ya que se apila en 3D y puede dar forma a configuraciones con buses de datos muy elevados. En este modelo en concreto, la memoria corría a 1 GHz, pero tenía un bus de 4.096 bits, lo que arrojaba un ancho de banda total de 512 GB/s.

Como ocurría con las tarjetas gráficas Radeon de la época, basadas en la arquitectura GCN, la Radeon R9 Fury X estaba preparada para ofrecer un buen aprovechamiento de las APIs Vulkan y DirectX 12, y su potencia bruta estaba muy por encima de la que ofrecía la GTX 980 Ti (8,6 TFLOPs frente a 6 TFLOPs). Sin embargo, el rendimiento de ambas en la mayoría de los casos era muy similar, y con el paso del tiempo la solución de AMD ha envejecido mucho peor.

La Radeon R9 Fury X sigue siendo una tarjeta gráfica capaz de ofrecer un buen rendimiento en cualquier juego actual con resolución 1080p, y también se desenvuelve bien en la mayoría de los casos en 1440p con calidades máximas, pero sus 4 GB de memoria gráfica le están pasando factura, y han hecho que esté envejeciendo mucho peor que la GTX 980 Ti. Teniendo en cuenta que ambas costaron lo mismo cuando llegaron al mercado, está claro que la segunda fue una mejor inversión.

Estamos ante un claro ejemplo de los problemas que da crear una tarjeta gráfica tope de gama tan desequilibrada. Montar una configuración muy potente y acompañarla de una cantidad de memoria gráfica propia de la gama media fue un gran error, y bastante difícil de entender, puesto que AMD ya había dado forma a tarjetas gráficas con 8 GB de memoria gráfica anteriormente (Radeon R9 290X y R9 390-390X). Entiendo que los altos costes de la memoria HBM motivaron esa decisión, pero no por ello deja de ser un error.

Su evolución en lo que a drivers se refiere tampoco ha sido nada buena, y en juegos relativamente antiguos basados en DirectX 11 pero muy utilizados todavía a día de hoy su rendimiento queda más cerca de la GTX 980 que de la GTX 980 Ti. Esto nos ayuda mucho a entender por qué merece estar en la lista de peores tarjetas gráficas de los últimos diez años.

4.-Las cinco peores tarjetas gráficas de la historia reciente: GTX 1060 de 3 GB

Cuando NVIDIA presentó las GTX 1060 nos sorprendió con un movimiento nada habitual, ya que decidió diferenciar entre dos modelos, uno equipado con 3 GB de memoria gráfica y otro acompañado de 6 GB de memoria gráfica. A priori podríamos pensar que, más allá de esa diferencia, ambas tarjetas gráficas eran iguales, pero nada más lejos de la realidad.

La GTX 1060 de 3 GB tiene 1.152 shaders, 72 unidades de texturizado, 48 unidades de rasterizado y un bus de 192 bits, además de esos 3 GB de GDDR5 a 8 GHz. Por contra, el otro modelo tiene 1.280 shaders y 80 unidades de texturizado, además del doble de memoria gráfica. Esas diferencias están marcando una distancia cada vez mayor en el rendimiento de ambas tarjetas gráficas, y han convertido a la GTX 1060 de 3 GB de una tarjeta gráfica que no está envejeciendo nada bien.

En su momento, este modelo llegó a costar más dinero que una RX 580, una tarjeta gráfica que está aguantando mucho mejor el paso del tiempo, y que gracias a los ajustes a nivel de drivers que ha introducido AMD ha vivido una especie de «segunda juventud».

No hay duda de que la GTX 1060 de 3 GB ofrece un buen rendimiento en muchos juegos, pero su baja cantidad de memoria gráfica y recorte a nivel de especificaciones le están pasando factura. En algunos juegos hemos visto que presenta tasas mínimas de fotogramas por segundo que llegan a caer incluso por debajo de los 30 FPS, y en títulos que requieren de una gran cantidad de memoria gráfica incluso en resoluciones 1080p, como DOOM Eternal, no solo «se ahoga», sino que además nos obliga a reducir la calidad gráfica de forma notable, de lo contrario no podremos mantener 60 FPS totalmente estables.

Fue una mala inversión, y con la nueva generación de consolas a la vuelta de la esquina su evolución solo puede ir a peor.

5.-Las cinco peores tarjetas gráficas de la historia reciente: Radeon RX 5500 XT de 4 GB

Estoy seguro de que más de uno se habrá llevado las manos a la cabeza al leer esta elección, pero tiene una explicación muy sencilla. Cuando AMD presentó la Radeon RX 5500XT anunció la disponibilidad de dos modelos, la versión de 4 GB y la de 8 GB. Ambas mantienen el mismo nivel de especificaciones, es decir, no se diferencian en conteo de shaders ni en frecuencias, solo en la cantidad de memoria integrada.

Hasta aquí todo bien, AMD había seguido el enfoque que vimos en las Radeon RX 570 y 580, que están disponibles en versiones de 4 GB y de 8 GB, pero tenemos dos problemas importantes. El primero es que las RX 5500 XT no ofrecen una mejora de rendimiento significativa que justifique su alto precio, ya que rinden casi al mismo nivel que las RX 580 y costaban más dinero. No eran una buena compra en relación precio-rendimiento.

Por otro lado, debemos tener en cuenta que las Radeon RX 5500 XT están limitadas a la interfaz PCIE Gen4 o Gen3 x8, un detalle importante que afecta de forma considerable al rendimiento de la tarjeta gráfica cuando la utilizamos en una ranura PCIE Gen3 x16, ya que solo aprovecha ocho líneas y se ve limitada por el menor ancho de banda disponible. Este problema no está presente cuando la conectamos a una ranura PCIE Gen4, y afecta también al modelo de 8 GB, aunque en menor medida.

En resumen, la Radeon RX 5500 XT de 4 GB es una tarjeta gráfica más cara que la RX 580 y con una importante limitación que le hace perder rendimiento en todos los casos, salvo que tengas un PC con una ranura PCIE Gen4, algo que incluso hoy es poco común. Con esto en mente, no debería sorprenderos que sea una de las peores tarjetas gráficas de los últimos años, se lo ha ganado a pulso.

-

PrácticosHace 2 días

PrácticosHace 2 díasCómo se usa Win10Privacy para controlar la privacidad en Windows

-

AnálisisHace 6 días

AnálisisHace 6 díasGIGABYTE MO27Q28GR análisis completo de este monitor WOLED

-

GuíasHace 4 días

GuíasHace 4 díasGuía de montaje de PC perfecto para gaming en 1080p por 858 euros

-

NoticiasHace 7 días

NoticiasHace 7 díasIntel Arc Serie G: Intel entra de lleno en el gaming portátil