Noticias

NVIDIA AI Decoded, desmitificando los LLMs, el cerebro detrás de los chatbots

Nuevo capítulo de la serie semanal NVIDIA AI Decoded, que arrancó la semana pasada con un artículo centrado en algunas de las claves más importantes en el mundo de la inteligencia artificial. Esta vez nos centramos en el lo que se conoce como LLMs, siglas de «large language models» o grandes modelos de lenguaje, que son el motor de los robots conversacionales, también conocidos como chatbots.

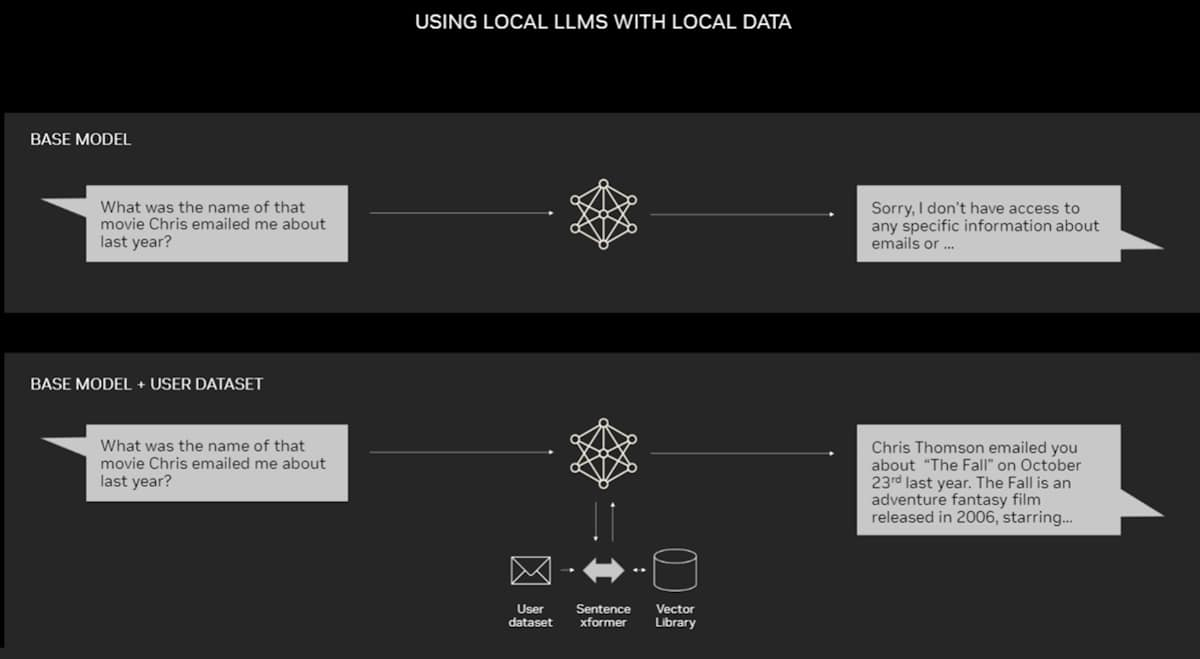

Uno de los mejores ejemplos de lo que puede ofrecer un robot conversacional lo tenemos en Chat with RTX, una plataforma que, como os conté en su momento, está llena de posibilidades, ya que puede trabajar con Llama2 13B INT4 y con Mistral 7B INT4, que utilizan respectivamente 13.000 millones y 7.000 millones de parámetros, y son dos de los modelos de lenguaje de inteligencia artificial más importantes a día de hoy.

¿Qué son los LLMs y cómo trabajan en GPUs NVIDIA?

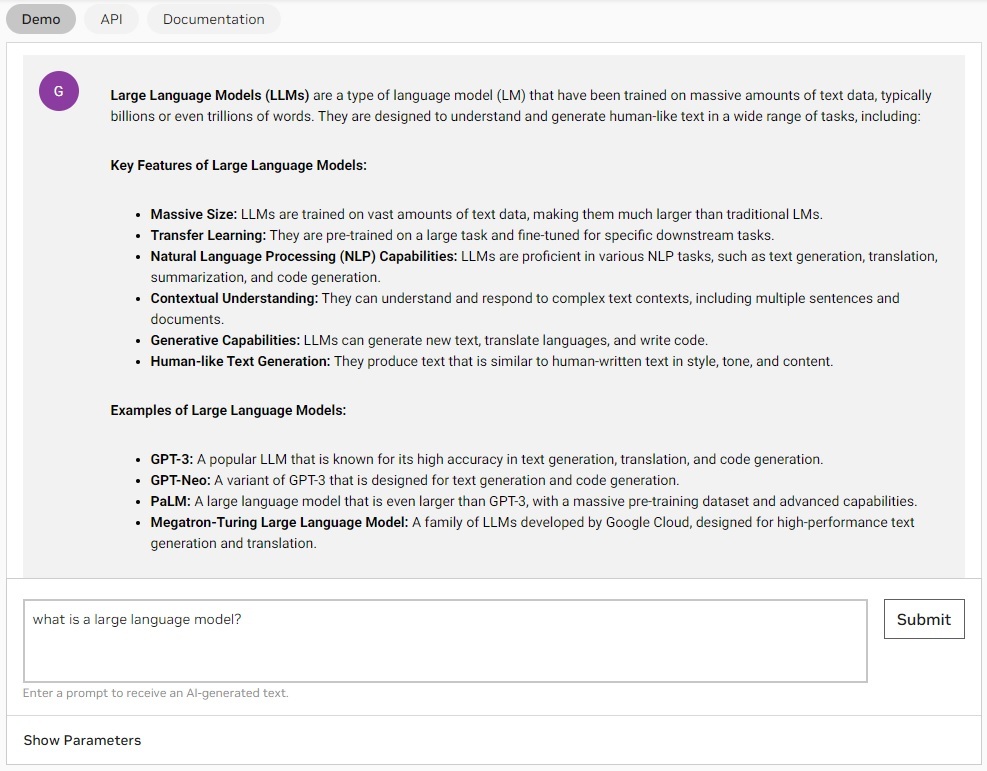

Los grandes modelos de lenguaje son algoritmos de aprendizaje profundo que han sido entrenados previamente con grandes cantidades de datos. Gracias a ese entrenamiento que han recibido son capaces de hacer ciertas cosas que hace unos años nos habrían parecido imposibles, como por ejemplo identificar y reconocer contenidos, traducirlos, resumirlos, predecir y generar texto y crear otros tipos de contenidos, incluyendo imágenes y vídeos.

Con esto en mente es fácil entender por qué podemos considerarlos como el cerebro detrás de los chatbots, porque son la parte inteligente de este tipo de plataformas. Sin los LLMs no existirían los chats conversacionales, no hay más. Estos modelos de lenguaje de gran tamaño hacen un trabajo excelente clasificando y resumiendo datos y grandes cantidades de texto, y pueden comunicarse en cualquier lenguaje, desde el que usamos los humanos hasta el código computacional, las secuencias genéticas y los proteinogramas.

Los chatbots basados en LLMs puede interactuar con humanos con un lenguaje totalmente natural, son fáciles de utilizar, y ofrecen una gran cantidad de posibilidades. A día de hoy se utilizan en diferentes niveles y mercados. Ente ellos podemos destacar, por ejemplo, el desarrollo y la codificación y la investigación científica, donde han ayudado a la creación de nuevos medicamentos y vacunas.

Como habréis podido imaginar todo esto tiene un alto coste a nivel de computación, y ahí es donde entran en juego las GPUs NVIDIA RTX, que cuentan con hardware especializado para acelerar tareas de IA. Estas, unidas a diferentes técnicas de optimización, han hecho que sea posible mover plataformas como Chat with RTX en local a partir de una modesta GeForce RTX 4060 Mobile, y disfrutando de un buen nivel de rendimiento.

¿Por qué son tan importantes los LLMs?

En parte ya hemos respondido a esta pregunta en el apartado anterior, porque ofrecen un mundo de posibilidades en sectores muy importantes, y porque además se pueden adaptar a una gran variedad de escenarios de uso, industrias y flujos de trabajo. Esto les confiere una gran versatilidad, y además ofrecen un alto nivel de rendimiento y una eficiencia significativa en casi cualquier tipo de tarea basada en el lenguaje.

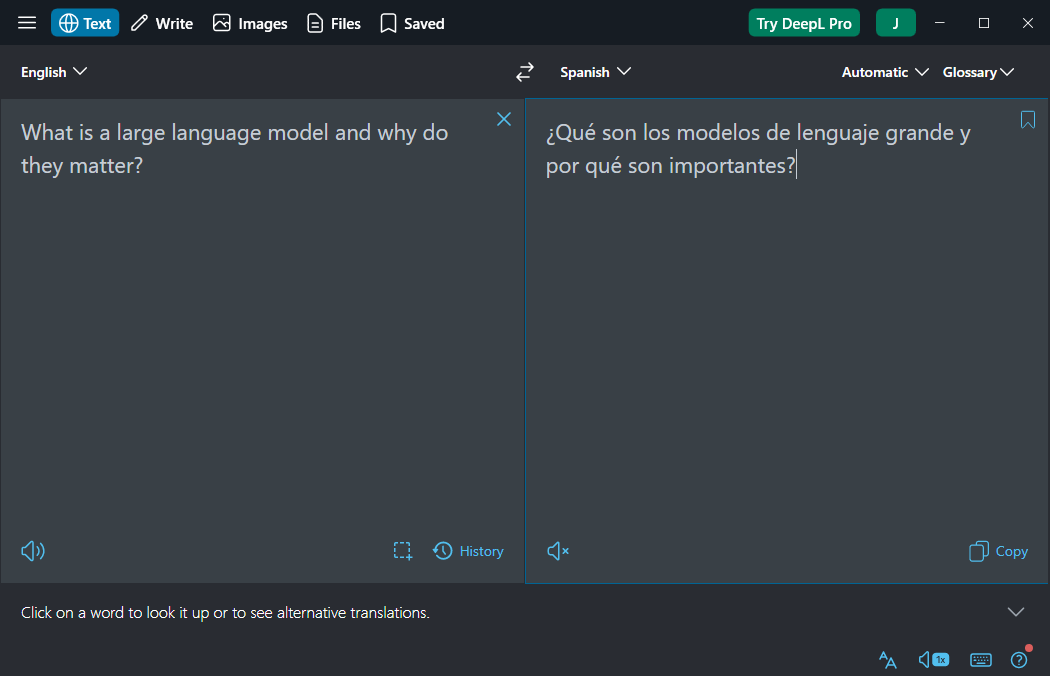

Con los LLMs también es posible conseguir traducciones lingüísticas mucho más precisas y mejor afinadas, podemos desarrollar y descubrir nuevos tratamientos médicos, crear nuevas experiencias de usuario, transcribir y resumir resultados financieros, crear imágenes y contenidos y muchas cosas más Su potencial es enorme, como dije anteriormente, y están transformando la manera en la que vivimos, y en la que trabajamos.

Utilizar un chatbot es tan fácil como hablar con una persona, porque al final lo único que tenemos que hacer es comunicarnos con él de forma natural. Esta simplicidad es lo que le ha dado tanto valor, y es una parte importante de la revolución que está consiguiendo esta tecnología. Los modelos más avanzados, y entrenados con una mayor cantidad de parámetros, pueden darnos respuestas a una enorme cantidad de preguntas.

Se espera que, en un futuro, los LLMs amplíen todavía más sus capacidades en aspectos tan importantes como la capacidad de pensamiento lógico, el razonamiento, las matemáticas y la división de peticiones complejas en subtareas más pequeñas. Esto último es muy importante, porque permite afinar mejor la resolución peticiones que requieren de diferentes tareas para ser completadas, como por ejemplo la reserva de unas vacaciones o la compra de un PC con una configuración determinada.

Si te has quedado con ganas de más te recomiendo que eches un vistazo al artículo completo que acaba de publicar NVIDIA en su blog oficial.

Imagen de portada generada con IA.

-

A FondoHace 4 días

A FondoHace 4 díasLos 10 mejores reproductores de vídeo para Android (gratis y sin publicidad)

-

PrácticosHace 12 horas

PrácticosHace 12 horasCómo mejorar la vida útil de la batería de un portátil

-

PrácticosHace 6 días

PrácticosHace 6 díasSeis usos de un pendrive USB más allá de almacenar archivos

-

GuíasHace 6 días

GuíasHace 6 díasCómo arrancar un PC Windows en el menor tiempo posible