La GPU es, sin duda, uno de los componentes más importantes, y más interesantes, de todos los que se utilizan actualmente para dar «vida» a un...

Nintendo Switch 2 ya es una realidad, y gracias a NVIDIA sabemos cosas muy importantes sobre la GPU de esta consola. Es cierto que todavía tenemos...

El gigante del chip tiene un importante as bajo la manga. El mánager de producto de Lenovo China ha comentado en Weibo que Intel está desarrollando...

Una prueba de rendimiento filtrada nos ha dejado ver cómo se comporta la GPU integrada que traerá el Intel Core Ultra 7 155H, un procesador que...

Justo ayer os contamos que Samsung iba a terminar su acuerdo con AMD porque quería desarrollar su propia GPU, una información que al final fue fruto...

El acuerdo entre Samsung y AMD para llevar la arquitectura gráfica de la segunda a los SoC Exynos del gigante surcoreano fue, sin duda, una de...

El mercado de gráficas, clave en computadoras personales y especialmente en las destinadas a juegos o aplicaciones profesionales de edición, alcanzó las 61,6 millones de unidades...

Con ese nombre, Hot Pixels, y sin más contexto, podemos llegar a conclusiones de lo más variadas a la hora de intentar averiguar de qué se...

[Opinión] El precio medio de las tarjetas gráficas dedicadas se ha duplicado en los últimos tres años y en 2021-22 alcanzó el punto de fuera de...

Microsoft ya ha dejado muy claro, en los últimos tiempos, su ferviente interés por la inteligencia artificial. Sus repetidas inversiones en OpenAI ya eran una señal...

La GPU integrada ha experimentado una evolución muy importante en la última década, tanto a nivel de rendimiento como de soporte de tecnologías clave. Esa evolución...

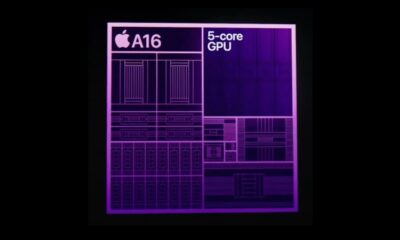

El iPhone 14 ha generado opiniones enfrentadas, y es comprensible, porque Apple pecó de un nuevo exceso de continuismo con dicha generación de smartphones, aunque lo...

La actual crisis económica, derivada en buena parte de la invasión de Ucrania por parte de Rusia, nos ha llevado a una contexto en el que...

La pasta térmica juega un papel fundamental en la correcta refrigeración de una CPU, y también de una GPU. Esto tiene una explicación muy sencilla, y...

Intel ha anunciado una familia de GPUs pensadas para estaciones de trabajo y aplicaciones profesionales. Se trata de la gama Arc Pro, compuesta por tres modelos: Intel Arc Pro...

Si la arquitectura x86/64 es la líder absoluta en el mundo del PC, podemos decir exactamente lo mismo de ARM si hablamos de smartphones, tablets y...

Presentadas hace ya bastantes meses, las gráficas Intel Arc han estado marcadas por unos contantes retrasos que llegaron a sembrar incluso la incertidumbre sobre si finalmente...

Filtradas e incluso fechadas desde hace tiempo, finalmente la espera ha llegado a su fin con la presentación oficial de la nueva generación de tarjetas gráficas...

AMD ampliará próximamente su línea de GPUs con nuevas Radeon RX 6000 que incluirán al menos tres versiones. Serán las RX 6950 XT, RX 6750 XT...

Más allá de las nuevas Geforce RTX 3090 Ti, e incluso las ya adelantadas gráficas de próxima generación, NVIDIA no sólo se está centrando en la...

La GPU Xclipse 920 es la gran novedad del SoC Exynos 2200 de Samsung y hay expectación por conocer el nivel que puede alcanzar y si...