Guías

GeForce RTX 30: todo lo que debes saber en diez claves

La arquitectura Ampere de NVIDIA, base de las GeForce RTX 30, representa un salto muy importante frente a la arquitectura Turing, que como sabemos ha sido utilizada en las GeForce RTX 20.

Durante el evento de presentación tuvimos la oportunidad de confirmar que las expectativas que se habían generado en base a numerosos rumores y supuestas filtraciones no eran para nada exageradas, y que el valor precio-prestaciones de las GeForce RTX 30 iba a ser muy superior comparado con el que ofrecieron, en su momento, las GeForce RTX serie 20.

El salto generacional que representan las GeForce RTX 30 es muy grande, y se define no solo por el aumento en términos de potencia bruta que ha conseguido NVIDIA, sino también por las mejoras que ha introducido tanto a nivel de trazado de rayos como de inteligencia artificial, y por las nuevas tecnologías que ha presentado, con las que promete marcar un punto de inflexión y potenciar nuestra experiencia en juegos.

Detrás de las GeForce RTX 30 hay muchas cosas importantes que debemos tener claras para entender de verdad cómo marcan la diferencia, qué valor ofrecen y hasta qué punto suponen un salto adelante frente a las GeForce RTX 20. Por ello, hemos querido hacer este artículo especial, donde encontraréis un resumen con las diez claves más importantes que definen a las nuevas tarjetas gráficas GeForce RTX 30 de NVIDIA.

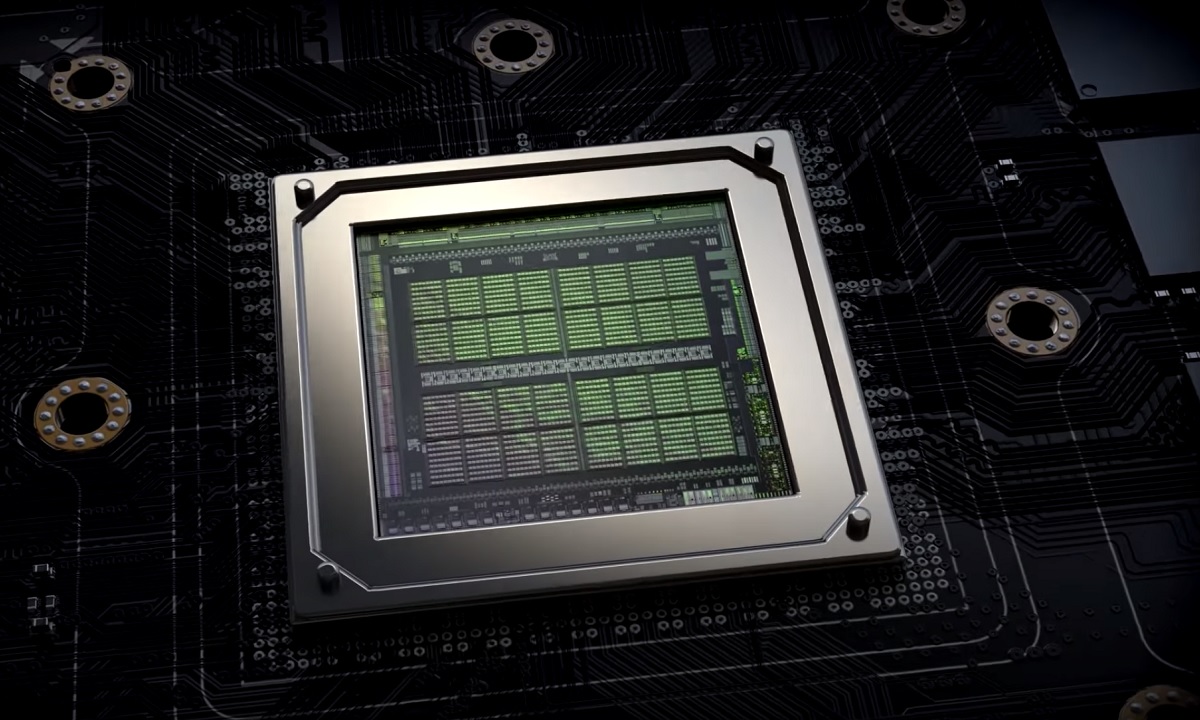

1.-Las GeForce RTX 30 doblan los motores de sombreado

Ha sido lo que más me ha sorprendido de esta nueva generación. Hasta el momento de la presentación, toda la prensa especializada estaba convencida de que la RTX 3090 iba a contar con 5.248 shaders, y que las RTX 3080 y RTX 3070 tendrían 4.352 y 2.944 shaders, respectivamente.

La sorpresa fue mayúscula cuando vimos que NVIDIA había doblado la cantidad de shaders en las nuevas GeForce RTX 30, lo que nos ha dejado una configuración de 10.496 shaders en la RTX 3090, 8.704 shaders en la RTX 3080 y 5.888 shaders en la RTX 3070.

Sé lo que estás pensando, ¿cómo ha doblado NVIDIA la cantidad de shaders? Pues muy sencillo, con un cambio en los bloques SM (streaming multiprocessors), el equivalente a las CU (unidades de computación) de AMD. Hasta ahora, cada SM contaba con 64 shaders, pero con Ampere NVIDIA ha dado el salto a una configuración de 128 shaders. Esto quiere decir que se mantiene el mismo número de unidades SM, y también el número de unidades de texturizado y de rasterizado, pero se dobla el número de shaders. La cantidad de núcleos RT y de núcleos tensor tampoco aumenta.

Si te sorprende este cambio no te preocupes, nosotros tampoco nos lo esperábamos, aunque no es la primera vez que NVIDIA juega con los shaders integrados en cada SM. Kepler, arquitectura utilizada en las GTX 600 y GTX 700, sumaba 192 shaders por cada unidad SM. Maxwell, arquitectura utilizada en las GTX 750-750 Ti y GTX 900, bajó el conteo a 128 shaders, cifra que se mantuvo en Pascal y que Turing redujo hasta los 64 shaders por SM.

2.-La serie GeForce RTX 30 ha dado un salto generacional muy grande

Cuando NVIDIA lanzó las GTX serie 600 se produjo una evolución muy importante. Los «hot shaders» quedaron abandonados, y la compañía multiplicó por tres el número de shaders para compensar la bajada de frecuencias de trabajo de aquellos. El resultado fue impresionante, la GTX 580 contaba con 512 shaders, y la GTX 680 llegó hasta los 1.536 shaders.

Hubo un salto muy grande en términos de rendimiento, y este se repitió al pasar de las GTX 700 a las GTX 9000. Por ejemplo, una GTX 970, que era gama alta «económica», rendía casi igual que una GTX 780 Ti, que fue el tope de gama inmediatamente anterior a dicha generación. La GTX 1070 hizo lo propio con la GTX 980 Ti, y confirmó un salto muy grande en términos de rendimiento que, por desgracia, no se repitió con Turing.

Las RTX serie 20 no ofrecían un buen valor en términos evolutivos si nos limitábamos a la potencia bruta. NVIDIA era consciente de ello, y por eso quiso llamar la atención de los usuarios con el trazado de rayos acelerado por hardware y el DLSS. Al final, debo decir que esta última tecnología ha sido lo más interesante que nos ha dejado Turing, y espero que se siga aprovechando debidamente en un número de juegos cada vez mayor.

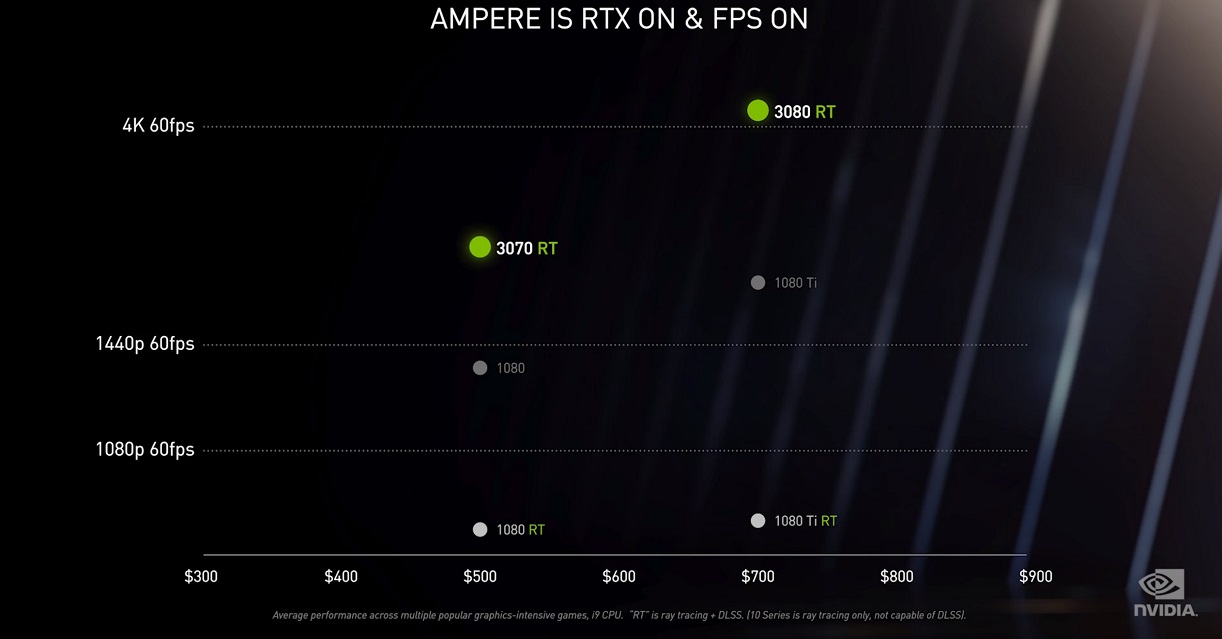

Con las GeForce RTX 30 se ha producido un salto similar al que vivimos al pasar de las GTX 900 a las GTX 10, ya que:

- La RTX 3070 supera a la RTX 2080 Ti, y es un 60% más potente que la RTX 2070.

- La RTX 3080 dobla a la RTX 2080, y supera a la RTX 2080 Ti hasta en un 35% (de media).

- La RTX 3090 rinde hasta un 50% más que la TITAN RTX.

3.-Memoria más rápida para conseguir un mayor ancho de banda

Las GeForce RTX 30 vienen equipadas con memoria GDDR6X en las series RTX 3090 y RTX 3080 funcionando a 19,5 GHz y 19 GHz. Esto, unido a un aumento de los buses de datos, que suben desde los 320 bits y 256 bits hasta los 384 bits y 320 bits, respectivamente, se traduce en un mayor ancho de banda.

La única que no ha salido bien parada en este sentido es la RTX 3070, que mantiene el bus de 256 bits y la memoria GDDR6 a 14 GHz. No obstante, su rendimiento ha mejorado de forma significativa, tanto que puede imponerse (en teoría) a la RTX 2080 Ti.

Además del aumento de la velocidad de la memoria y del bus de datos, NVIDIA ha decidido montar una mayor cantidad de memoria gráfica en las RTX 3090 y RTX 3080. La primera cuenta con 24 GB de GDDR6X, una cifra que, hasta ahora, quedaba reservada a la serie TITAN, y que supone un salto importante frente a los 11 GB de la RTX 2080 Ti.

Por su parte, la RTX 3080 sube hasta los 10 GB de memoria GDDR6X (la RTX 2080 tiene 8 GB). La RTX 3070 mantiene los 8 GB de GDDR6 a 14 GHz, lo que nos deja una configuración idéntica a la de la RTX 2070.

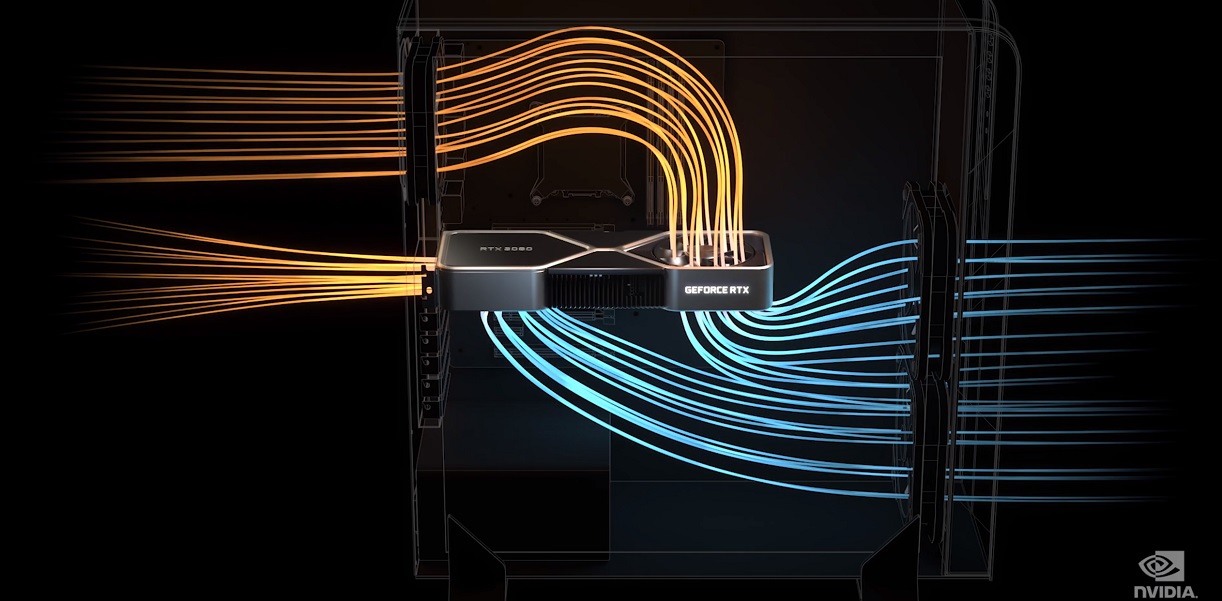

4.-Nuevo sistema de refrigeración para que las temperaturas no sean un problema

La arquitectura NVIDIA Ampere ha permitido crear GPUs más potentes, pero también más «tragonas» y más «calentorras». Basta ver el TDP que tiene la RTX 3090 y compararlo con el de la RTX 2080 Ti para darnos cuenta de ello, 350 vatios frente a 250 vatios, y lo mismo ocurre con la RTX 3080, que tiene un TDP de 320 vatios.

Para que el calor no sea un problema, NVIDIA ha rediseñado por completo el PCB de los modelos Founders Edition, y ha utilizado un sistema de refrigeración que parte de un PCB irregular y monta un enorme radiador con dos ventiladores en caras opuestas. Esto mejora la entrada de aire frío y la salida de aire caliente, como vemos en la imagen.

Según NVIDIA, este sistema de refrigeración ha permitido reducir las temperaturas de trabajo hasta en 20 grados, siempre comparando con los valores obtenidos con los sistemas de refrigeración de las RTX 20 Founders Edition.

Será interesante ver cómo se comportan las RTX 3090 y RTX 3080 con los diseños personalizados de cada fabricante, pero está claro que deberán cuidarlos al máximo para evitar problemas de temperatura en ambos modelos. La RTX 3080 es otro cantar, ya que tiene un TDP más bajo y se defiende perfectamente con un sistema de refrigeración más modesto.

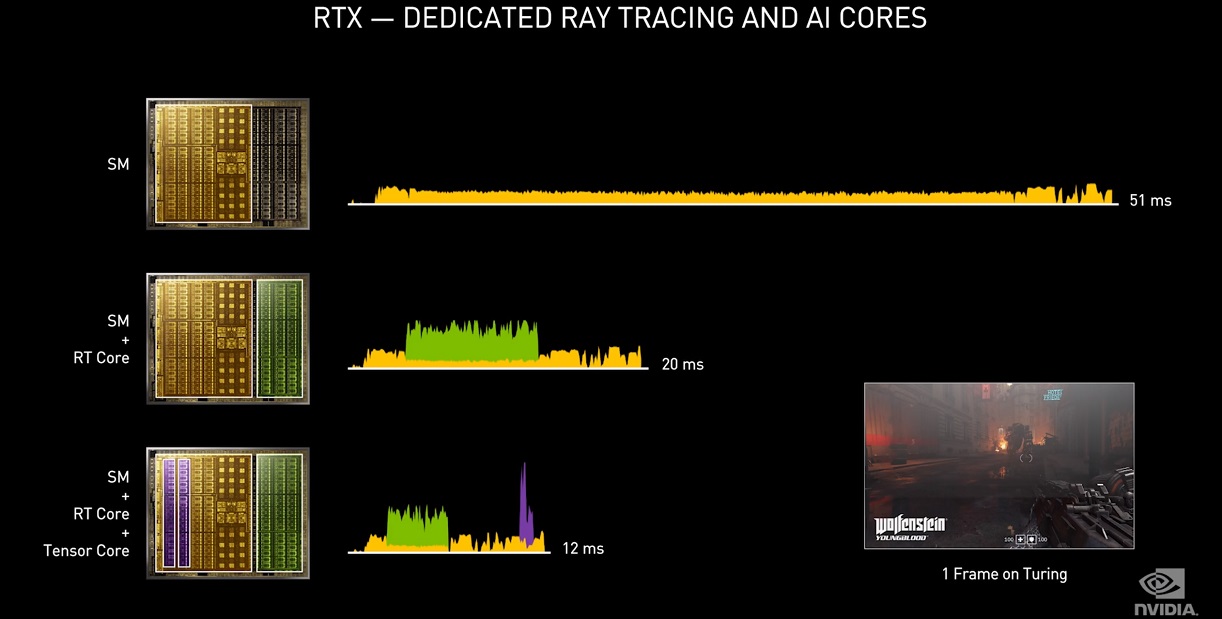

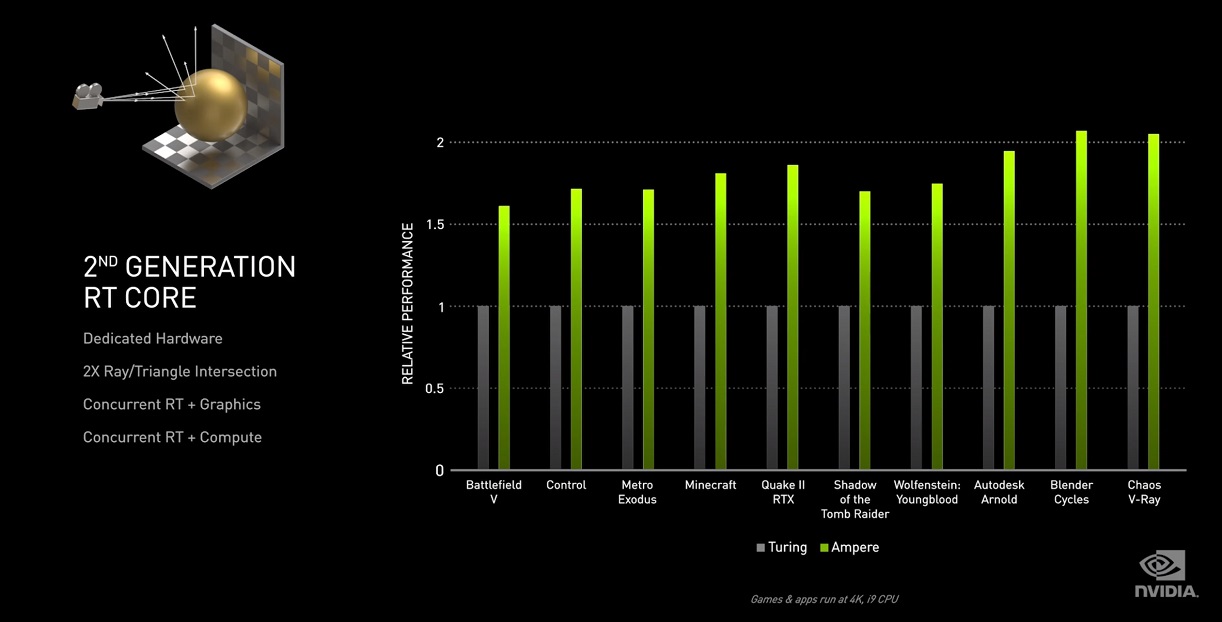

5.-Las GeForce RTX 30 utilizan núcleos RT de segunda generación

Ya hemos dicho que las GeForce RTX 30 no doblan la cantidad de núcleos RT, pero esto no quiere decir que no se hayan introducido mejoras, más bien todo lo contrario, ya que NVIDIA dejó claro que su nueva arquitectura ha subido el listón en lo que a trazado de rayos se refiere.

Las GeForce RTX 30 utilizan núcleos RT de segunda generación, capaces de ofrecer un 70% más de rendimiento que los núcleos RT de primera generación presentes en Turing. Esto ya nos dice que estamos ante un salto muy grande, y que por fin podremos jugar en resolución 4K con trazado de rayos activo manteniendo 60 FPS estables.

Es importante recordar que todavía nos encontramos ante una arquitectura de renderizado híbrida, es decir, NVIDIA Ampere mantiene la división en shaders, núcleos tensor y núcleos RT que vimos en Turing, lo que significa que adopta el mismo enfoque de renderizado híbrido a través de rasterizado, IA para reescalado inteligente y trazado de rayos limitado a aspectos concretos.

Con todo, vamos a vivir una evolución importante en este sentido. El trazado de rayos dejará de estar limitado a un aspecto gráfico concreto, es decir, los desarrolladores ya no tendrán que elegir entre aplicar trazado de rayos a sombras, oclusión ambiental, iluminación o reflejos, podrán aplicarlo a todos esos frentes, y como sabrán muchos de nuestros lectores Cyberpunk 2077 será el gran abanderado de este cambio.

6.-Núcleos tensor de tercera generación

La cantidad de núcleos tensor presente en las GeForce RTX 30 tampoco ha aumentado frente a las GeForce RTX 20, pero NVIDIA ha introducido, como el caso de los núcleos RT, mejoras importantes que permiten conseguir una mejora enorme de rendimiento, tanto que pasamos de 89 tensor TFLOPs a 238 tensor TFLOPs.

Este salto es importante porque abre nuevos horizontes de cara al aprovechamiento de nuevos algoritmos para potenciar los beneficios de la inteligencia artificial en el mundo de los videojuegos, y obviamente también eleva el valor de las GeForce RTX 30 como soluciones gráficas capaces de cubrir las necesidades de cualquier usuario conciliando trabajo y ocio.

Por si alguien tiene dudas sobre mi última afirmación, me explico. Las GeForce RTX 30 tendrán soporte en los Studio Driver de NVIDIA, lo que significa que podremos utilizar sus núcleos tensor y núcleos RT en numerosas aplicaciones y herramientas profesionales para conseguir un mejor rendimiento. Es decir, su potencial no se limita a los juegos.

Será interesante ver cómo evoluciona la inteligencia artificial aplicada a mejorar el rendimiento en juegos, y sobre todo qué diferencias consigue marcar NVIDIA con la tecnología DLSS 3.0. De momento ya sabemos que DLSS 2.1 permitirá reescalar de forma inteligente en juegos bajo realidad virtual, un avance muy importante dado que en esos entornos es necesario renderizar la imagen en dos pantallas.

7.-GeForce RTX 3090: la primera capaz de mover juegos en 8K

NVIDIA está muy orgullosa de las GeForce RTX 30, pero especialmente de la RTX 3090, una tarjeta gráfica tope de gama que, como sabemos, es la sucesora de la RTX 2080 Ti.

Al cambiar de nomenclatura y recuperar la numeración «xx90», NVIDIA se ha dejado un as bajo la manga, ya que puede aprovechar para lanzar, si lo necesita, una RTX 3090 Super o una RTX 3090 Ti. Todo dependerá de lo que presente AMD a lo largo de los próximos meses. Si la compañía de Sunnyvale pone en el mercado una tarjeta gráfica tope de gama basada en RDNA 2 capaz de plantar cara a la RTX 3090, estoy seguro de que NVIDIA no dudará en lanzar una revisión de aquella.

La RTX 3090 es un auténtico monstruo con 10.496 shaders que es capaz de mover, según NVIDIA, juegos en resolución 8K, aunque recurriendo para ello al reescalado inteligente DLSS. Sé lo que estáis pensando, que hay truco, y sí, es cierto, pero el resultado que consigue esta tecnología ha sido capaz de superar al clásico sistema de renderizado nativo con filtrado TAA, así que no deja de ser una buena noticia.

En su momento pudimos confirmar que una TITAN RTX era capaz de mover Death Stranding en 8K con DLSS 2.0 manteniendo un rendimiento más que aceptable. Dado que la RTX 3090 es hasta un 50% más potente que la TITAN RTX, podemos sacar en claro que debería ser capaz de mover dicho juego en 8K bajo DLSS 2.0 manteniendo 60 FPS estables, al menos en teoría.

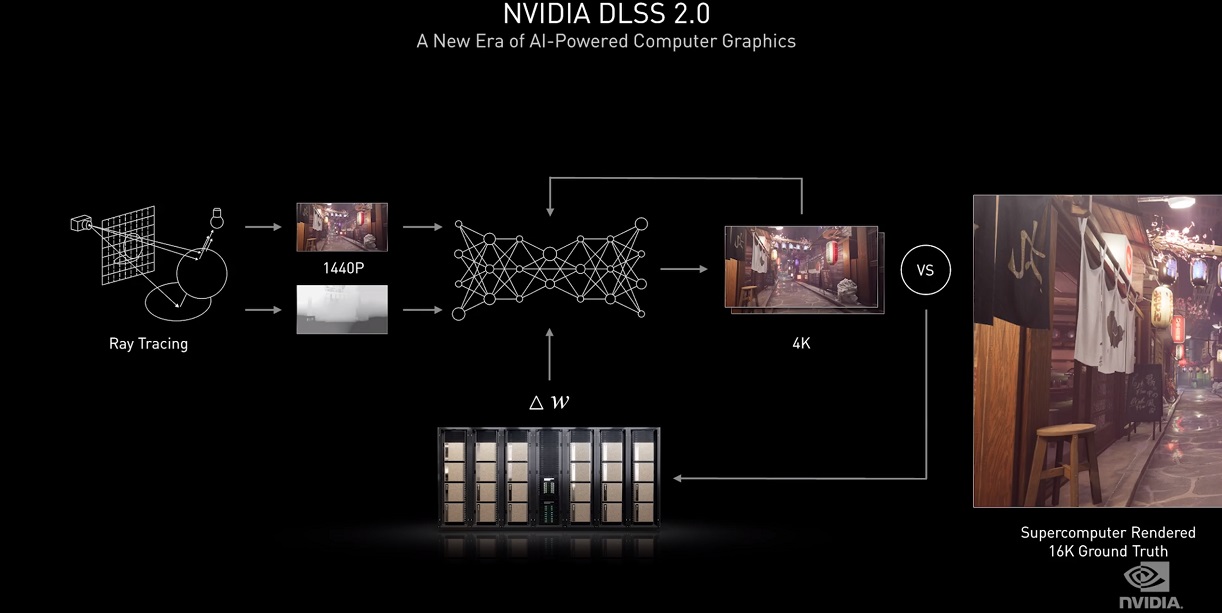

8.-Valor añadido a través de la inteligencia artificial

La inteligencia artificial aplicada a videojuegos nos ha dejado la tecnología DLSS 2.0, una auténtica maravilla que es capaz de renderizar una imagen utilizando un 50% menos de píxeles y de crear, combinando varias imágenes, una nueva imagen con una calidad que no tiene nada que envidiar a su equivalente nativo, es decir, a su equivalente con el doble de píxeles.

Con la presentación de las GeForce RTX 30, NVIDIA ha querido subir el listón y ha presentado nuevos avances que permiten aprovechar el potencial de la inteligencia artificial, y de los núcleos tensor presentes en dichas tarjetas gráficas.

Entre las novedades más importantes podemos destacar NVIDIA Broadcast, que nos permite convertir nuestra habitación en un estudio profesional, gracias a una serie de funciones que suponen un importante valor añadido para cualquier streamer, como por ejemplo cancelación de ruido potenciada mediante inteligencia artificial, creación de fondos virtuales y enfoque automático de la cámara.

En principio todas estas novedades también serán compatibles con las RTX serie 20, ya que se apoyan en los núcleos tensor, y dichas tarjetas gráficas incluyen ese tipo de hardware.

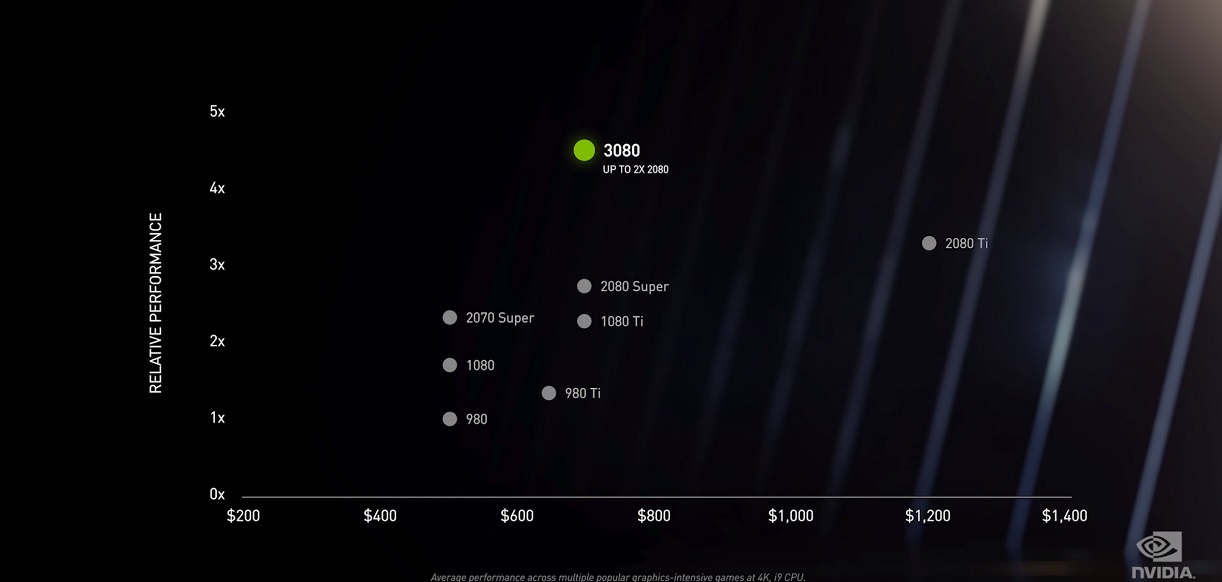

9.-Las GeForce RTX 30 tienen un precio competitivo

Sí, ya sé que más de uno se acaba de llevar las manos a la cabeza, pero este punto es muy fácil de entender. Vamos a verlo de una manera directa y clara:

- RTX 3070: tiene un precio de 519 euros y rinde más que la RTX 2080 Ti, que cuesta 1.259 euros.

- RTX 3080: costará 719 euros, y rinde como dos RTX 2080. Cada RTX 2080 costaba 849 euros, así que el coste total sería de 1.698 euros.

- RTX 3090: costará 1.549 euros, y rinde un 50% más que la TITAN RTX, que cuesta 2.499 euros.

Los números no mienten. Está claro que las GeForce RTX 30 no son baratas, y que el precio de las tarjetas gráficas ha subido notablemente durante los últimos años, pero esto no quiere decir que las GeForce RTX 30 no ofrezcan un valor sólido en relación coste-prestaciones.

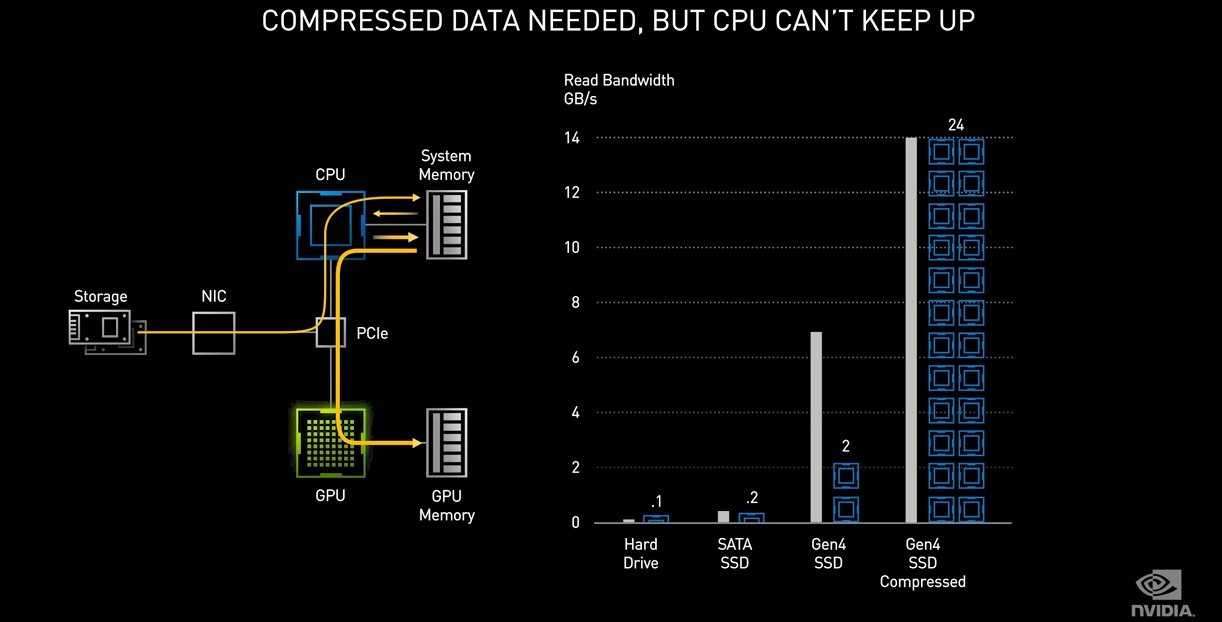

10.-La tecnología RTX IO puede marcar un punto de inflexión

Se trata, como os contamos en su momento, de una tecnología que permite utilizar la GPU para acelerar la carga de trabajo derivada de la descompresión de datos provenientes del SSD. Esto consigue reducir enormemente la utilización de la CPU para estas tareas.

Varias fuentes aseguran que la carga de trabajo que esto representa a nivel de CPU es tan grande que se necesitan hasta dos núcleos completos para obtener un buen rendimiento en las tareas de descompresión. Gracias a la tecnología RTX IO de NVIDIA, este problema sería cosa del pasado, ya que la GPU pasaría a ocuparse de todo.

Esta tecnología parte de una base similar a la que hemos visto en Xbox Series X, y sí, cuenta con el apoyo de Microsoft, de hecho trabaja con la API Direct Storage, presente en DirectX 12. Sin embargo, hay una mala noticia, y es que tiene que ser soportada por los desarrolladores en cada juego concreto, lo que significa que requiere de un esfuerzo extra que no todos estarán dispuestos a hacer.

Bien aplicada, esta tecnología permitiría reducir al mínimo los tiempos de carga y el consumo de recursos a nivel de CPU.

-

PrácticosHace 5 días

PrácticosHace 5 díasCómo se usa Win10Privacy para controlar la privacidad en Windows

-

GuíasHace 7 días

GuíasHace 7 díasGuía de montaje de PC perfecto para gaming en 1080p por 858 euros

-

A FondoHace 6 días

A FondoHace 6 díasNVIDIA presenta el «superchip» RTX Spark, un nuevo camino para Windows sobre ARM

-

NoticiasHace 7 días

NoticiasHace 7 díasDuckDuckGo, el éxito de la búsqueda sin IA